OpenAI Feud: Potere, Fiducia e i Confini Incontrollabili dell'AGI

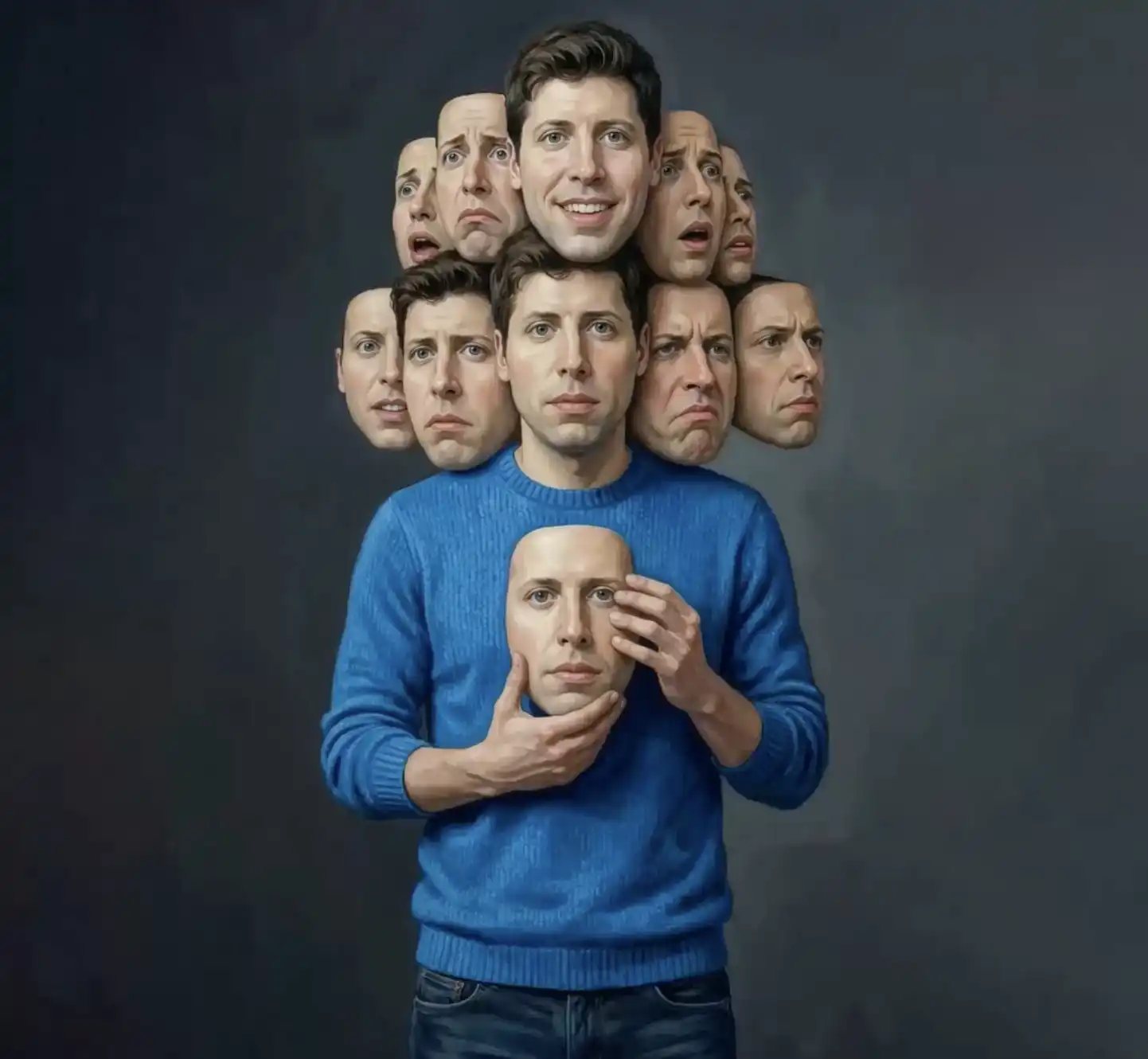

Titolo dell'Articolo Originale: Sam Altman Può Controllare il Nostro Futuro—Possiamo Fidarci di Lui?

Autori dell'Articolo Originale: Ronan Farrow e Andrew Marantz, il New Yorker

Traduzione: Peggy, BlockBeats

Nota dell'Editore: Questo articolo, attraverso un gran numero di documenti inediti e interviste approfondite, rivede la crisi interna all'interno di OpenAI riguardo al potere e alla fiducia di Sam Altman. Dalla destituzione del consiglio a una rapida riassegnazione in una "reversibilità simile a un colpo di stato", questo tumulto non è stato un evento isolato ma un'eruzione concentrata di conflitti di governance di lunga data.

Al centro del conflitto c'è un continuo tira e molla tra due logiche: da un lato, la missione non profit di OpenAI fondata su "la sicurezza umana prima di tutto", e dall'altro, un graduale spostamento verso un percorso di sviluppo orientato ai prodotti, alla scala e ai ricavi man mano che l'AGI si avvicina e la commercializzazione accelera. In questo processo, gli impegni per la sicurezza sono stati continuamente indeboliti e il potere e il processo decisionale si sono gradualmente centralizzati tra pochi.

Molti personaggi chiave, tra cui Ilya Sutskever e Dario Amodei, hanno messo in discussione Altman, concentrandosi sull'opacità delle informazioni e sull'espressione strategica, ritenendo che il suo stile di leadership non sia sufficiente per governare robustamente la tecnologia che "cambierà il destino dell'umanità"; i suoi sostenitori, tuttavia, sottolineano che la sua capacità di integrazione delle risorse, operazione di capitale ed esecuzione è fondamentale per la rapida espansione di OpenAI.

Quando il potere tecnologico è sufficiente per influenzare l'ordine globale, la struttura di governance aziendale esistente è ancora sufficiente per vincolare gli individui? In altre parole, nell'era dell'IA, la vera incertezza potrebbe non provenire solo dalla tecnologia stessa, ma da coloro che controllano la tecnologia.

Di seguito è riportato l'articolo originale:

Potere e Fiducia: Fessure nella governance sotto la leadership di Altman

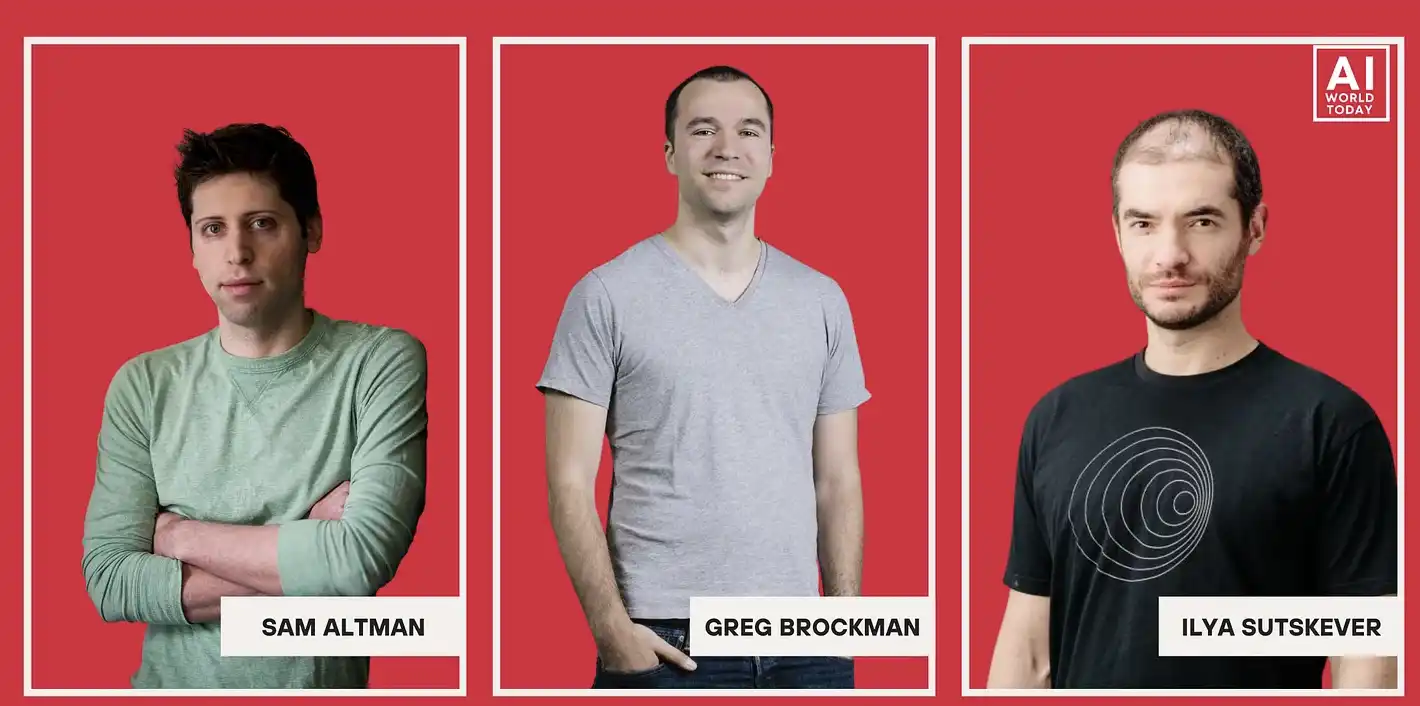

Nell'autunno del 2023, il Chief Scientist di OpenAI, Ilya Sutskever, ha inviato un memo segreto agli altri tre membri del consiglio dell'azienda. Nelle settimane precedenti, avevano discusso privatamente di una questione delicata: se il CEO dell'azienda, Sam Altman, e il suo vice, Greg Brockman, fossero ancora idonei a continuare a guidare l'azienda.

Fonte dell'immagine: AI MONDO OGGI

Sutskever una volta considerava entrambi amici. Nel 2019, ha persino ospitato il matrimonio di Brockman presso l'ufficio di OpenAI, dove c'era anche un braccio robotico che fungeva da "portarings."

Ma man mano che si convinceva sempre di più che l'azienda stesse avvicinandosi al suo obiettivo a lungo termine — creare un'intelligenza artificiale in grado di eguagliare o superare le capacità cognitive umane — i suoi dubbi su Altman si approfondirono. Come disse a un altro membro del consiglio all'epoca, "Non penso che Sam sia la persona che dovrebbe avere il dito sul pulsante."

Su richiesta di altri membri del consiglio, Sutskever, insieme a colleghi affini, ha messo insieme un documento di circa settanta pagine, comprese le chat di Slack, i file delle risorse umane e commenti a corredo. Alcuni dei contenuti erano persino screenshot presi con un telefono, apparentemente per evitare il monitoraggio da parte dei dispositivi aziendali. Alla fine, ha inviato questi memo ad altri membri del consiglio in modo "leggi-e-brucia" per garantire che non venissero visti da più persone.

"Era davvero spaventato in quel momento," ha ricordato un direttore che ha ricevuto i materiali. Abbiamo esaminato questi memo, che non erano mai stati completamente divulgati prima. I documenti accusavano Altman di distorcere i fatti agli esecutivi e ai membri del consiglio e di comportamenti ingannevoli riguardo ai protocolli di sicurezza interni. Un memo su Altman iniziava con un elenco di elementi intitolato "Sam ha costantemente dimostrato…," con il primo elemento che era "Mentire."

Molte aziende tecnologiche affermano di "rendere il mondo un posto migliore," ma le loro operazioni reali ruotano attorno alla massimizzazione dei ricavi. Il principio fondante di OpenAI, tuttavia, doveva essere diverso da questo modello. I suoi fondatori, tra cui Altman, Sutskever, Brockman ed Elon Musk, credevano che l'intelligenza artificiale potesse essere una delle invenzioni più potenti e potenzialmente pericolose nella storia umana. Contesto di questo "rischio esistenziale," l'azienda potrebbe richiedere una struttura organizzativa non convenzionale.

OpenAI è stata inizialmente fondata come un'organizzazione senza scopo di lucro, con il suo consiglio incaricato di mettere "la sicurezza di tutta l'umanità" al di sopra del successo dell'azienda, persino prioritizzandola rispetto alla stessa sopravvivenza dell'azienda. Il CEO deve possedere un carattere e un'etica straordinari.

Come ha detto Sutskever, "Chiunque sia coinvolto nella costruzione di questa tecnologia che potrebbe cambiare la civiltà così come la conosciamo porta una grande responsabilità e un dovere senza precedenti." Ma ha anche osservato che "coloro che si trovano in queste posizioni sono spesso di un certo tipo: persone affamate di potere, tipi politici, o coloro che semplicemente godono del potere per il suo stesso bene." In un memo, ha espresso preoccupazione per l'affidare questa tecnologia a qualcuno "che dice solo ciò che gli altri vogliono sentire."

Se il CEO di OpenAI si rivelasse infine inaffidabile, allora questo consiglio di amministrazione di sei persone ha il potere di destituirlo. Alti dirigenti, tra cui l'esperta di politiche AI Helen Toner e l'imprenditrice Tasha McCauley, sono diventati più convinti del loro giudizio precedente dopo aver letto questi memo: ciò che Altman assumeva fosse una responsabilità riguardante il futuro dell'umanità, ma lui stesso non era affidabile.

Colpo di Stato in Consiglio: Sam Altman Licenziato

In quel momento, Sam Altman si trovava a Las Vegas a guardare una gara di Formula Uno quando Ilya Sutskever lo ha invitato a una videochiamata con il consiglio di amministrazione e ha letto una breve dichiarazione annunciando che non era più un dipendente di OpenAI. Il consiglio, su consiglio legale, ha emesso una dichiarazione pubblica, affermando che Altman era stato destituito per "non aver mantenuto costantemente l'onestà nella comunicazione."

Questa decisione ha scioccato molti degli investitori e dei dirigenti di OpenAI. Microsoft, che aveva investito circa 13 miliardi di dollari in OpenAI, ha appreso della notizia all'ultimo minuto prima che la decisione fosse eseguita. "Ero incredibilmente sorpreso in quel momento," ha ricordato in seguito il CEO di Microsoft Satya Nadella. "Non riuscivo a ottenere ulteriori informazioni da nessuno." Ha poi contattato Reid Hoffman (cofondatore di LinkedIn, investitore di OpenAI e direttore di Microsoft), che ha iniziato a chiedere ovunque se Altman avesse commesso qualche chiaro illecito. "Ero totalmente confuso in quel momento," ci ha detto Hoffman. "Stavamo cercando problemi come appropriazione indebita o molestie, ma non ho trovato nulla."

Altri partner commerciali sono stati altrettanto colti di sorpresa. Quando Altman ha chiamato l'investitore Ron Conway per informarlo del suo licenziamento, Conway stava pranzando con la congressista statunitense Nancy Pelosi, e gli ha passato il telefono sul posto. "È meglio che tu te ne vada rapidamente," disse a Conway.

Nel frattempo, OpenAI era vicina a completare un importante round di finanziamento da parte della società di venture capital Thrive Capital, fondata da Josh Kushner, anche lui fratello di Jared Kushner, che Altman conosceva da molti anni. Questo accordo avrebbe valutato OpenAI 86 miliardi di dollari e avrebbe permesso a molti dipendenti di incassare milioni di dollari in benefici azionari. Kushner aveva appena terminato un incontro con il produttore musicale Rick Rubin quando vide la chiamata persa di Altman e la richiamò. "Siamo immediatamente entrati in modalità battaglia," ricordò poi.

Il giorno del suo licenziamento, Altman volò di ritorno nella sua villa da 27 milioni di dollari a San Francisco, che si affacciava su tutta la baia con una piscina a sfioro sospesa, dove allestì un centro di comando temporaneo che chiamò "una sorta di governo esiliato." Conway, il cofondatore di Airbnb Brian Chesky e il famoso gestore di crisi PR Chris Lehane si unirono via video e telefono, parlando a volte per ore. Alcuni membri del team esecutivo di Altman si accamparono persino nei corridoi della casa. Gli avvocati si posizionarono nel suo ufficio a casa accanto alla camera da letto. Durante i periodi di insonnia, Altman camminava avanti e indietro in pigiama. Descrivendo questa esperienza post-licenziamento in una recente intervista, la definì "una strana sorta di stato di fuga."

Con il consiglio che rimaneva in silenzio, il team di consulenza di Altman iniziò a costruire una narrazione per il suo ritorno. Lehane insistette sul fatto che il licenziamento fosse in realtà un "colpo di stato" orchestrato da "altruisti efficaci," sostenitori di un sistema di pensiero che enfatizza la massimizzazione del benessere umano complessivo, che vedevano l'intelligenza artificiale come una minaccia esistenziale. (Hoffman suggerì anche a Nadella all'epoca che il licenziamento potesse essere dovuto a "una sorta di follia altruistica efficace.") Lehane, il cui motto ampiamente diffuso era preso in prestito da Mike Tyson, "Tutti hanno un piano fino a quando non vengono colpiti in faccia," suggerì ad Altman di lanciare un'audace offensiva sui social media. Chesky rimase in contatto con la giornalista tecnologica Kara Swisher, ripetendo costantemente le critiche al consiglio verso il mondo esterno.

Ogni sera alle sei, Altman emergeva dalla sua "sala di guerra" per versarsi un Negroni. Ricordò di aver detto a coloro che lo circondavano, "Devi rilassarti; ciò che deve accadere accadrà." Tuttavia, aggiunse che i registri delle chiamate mostravano che era al telefono per oltre dodici ore al giorno in quel periodo.

A un certo punto, una fonte rivelò che Altman disse a Mira Murati, che allora ricopriva il ruolo di CEO ad interim di OpenAI, che i suoi alleati stavano "dando il massimo" e cercando di "scoprire scheletri nell'armadio" per danneggiarla e altri coinvolti nella sua rimozione. (Altman stesso afferma di non ricordare questa conversazione.)

Nel giro di poche ore dal suo licenziamento, Thrive Capital aveva sospeso il suo investimento pianificato e aveva chiarito che solo se Sam Altman fosse tornato, l'affare sarebbe andato in porto e i dipendenti avrebbero raccolto i frutti delle loro azioni. I registri dei messaggi di testo dell'epoca mostrano che Altman era in comunicazione molto frequente con Satya Nadella. (Nel redigere una dichiarazione congiunta, Altman suggerì di formularla così: "Satya e la mia massima priorità in questo momento è salvare OpenAI," mentre Nadella propose una formulazione diversa: "Assicurarsi che OpenAI continui a prosperare.")

Ribaltamento di potere: Altman reintegrato rapidamente dopo 5 giorni

Poco dopo, Microsoft annunciò che avrebbe lanciato un progetto competitivo per Altman e per qualsiasi dipendente di OpenAI che fosse andato via. Allo stesso tempo, una lettera pubblica che richiedeva il ritorno di Altman iniziò a circolare all'interno dell'azienda. Alcuni che inizialmente erano riluttanti a firmare ricevettero chiamate e messaggi supplicanti dai colleghi. Alla fine, la maggior parte dei dipendenti di OpenAI minacciò una dimissione collettiva a sostegno di Altman.

Il consiglio si trovava in una situazione difficile. "Control Z, è un'opzione," disse Helen Toner — riferendosi all'annullamento della decisione di licenziamento. "L'altra opzione è il collasso totale." Anche l'allora CEO ad interim Mira Murati alla fine firmò la lettera pubblica. Gli alleati di Altman iniziarono a cercare di persuadere Ilya Sutskever a cambiare idea. La moglie di Brockman, Anna, si avvicinò persino a lui in ufficio e disse: "Sei una brava persona, puoi rimediare a questa situazione." Sutskever spiegò poi in una testimonianza in tribunale: "In quel momento sentivo che se avessimo intrapreso la strada del non ritorno di Sam, OpenAI sarebbe stata distrutta."

Una notte, Altman assunse il sonnifero Ambien e fu svegliato da suo marito, il programmatore australiano Oliver Mulherin, che gli disse che la posizione di Sutskever stava vacillando e suggerì ad Altman di comunicare immediatamente con il consiglio. "Mi sono svegliato in una sorta di confusione indotta da Ambien," ricordò Altman, "e mi sentivo completamente disorientato e pensai: 'Non c'è modo che possa parlare con il consiglio in questo momento.'"

In una serie di chiamate sempre più tese, Sam Altman chiese le dimissioni dei membri del consiglio che avevano spinto per il suo licenziamento. Riflettendo sull'idea di tornare, ricordò la sua reazione iniziale come, "Devo sistemare il loro pasticcio in questo ambiente incredibilmente sospetto?" "Pensai, assolutamente no," disse. Alla fine, Ilya Sutskever, Helen Toner e Tasha McCauley persero i loro posti nel consiglio, lasciando solo Adam D'Angelo (co-fondatore di Quora) come l'unico membro originale rimasto.

Come parte dei termini di dimissioni, questi membri del consiglio richiesero un'indagine sulle accuse contro Altman — inclusa la creazione di divisioni tra i dirigenti e la dissimulazione di legami finanziari. Chiesero anche l'istituzione di un nuovo consiglio per supervisionare in modo indipendente l'indagine esterna. Tuttavia, i due nuovi direttori nominati — l'ex presidente dell'Università di Harvard Lawrence Summers e l'ex CTO di Facebook Bret Taylor — furono selezionati dopo una stretta comunicazione con Altman. "Pensi che questo funzioni," scrisse Altman a Satya Nadella, "con Bret, Larry Summers e Adam nel consiglio, io come CEO e Bret a guidare l'indagine?" (McCauley testimoniò in seguito che quando Taylor era in considerazione per il consiglio, era preoccupata che potesse essere troppo deferente verso Altman.)

Meno di cinque giorni dopo essere stato licenziato, Altman fu reintegrato. I dipendenti dell'azienda avrebbero in seguito fatto riferimento a questo periodo come il "Blip," attingendo a un punto della trama di un film Marvel — una breve scomparsa seguita da un ritorno, ma il mondo era stato fondamentalmente alterato dalla loro assenza.

Tuttavia, la controversia riguardante l'affidabilità di Altman era da tempo trapelata oltre la sala del consiglio di OpenAI. Il collega che aveva orchestrato il suo allontanamento lo accusò di un comportamento ingannevole pervasivo, che sarebbe inaccettabile per qualsiasi dirigente aziendale, tanto meno per un leader in possesso di una tecnologia così trasformativa. "Abbiamo bisogno di controlli sul potere che siano commisurati a quel potere," ci disse Mira Murati. "Il consiglio aveva chiesto un feedback, e io ho semplicemente condiviso onestamente ciò che ho visto, e sostengo questa posizione." I sostenitori di Altman, d'altra parte, avevano a lungo minimizzato queste accuse. Dopo il licenziamento, l'investitore Ron Conway aveva messaggiato Brian Chesky e Chris Lehane, esortando a una controffensiva PR: "Questo riguarda la reputazione di Sam." Disse anche al Washington Post che Altman era trattato ingiustamente da "un consiglio che è fuori controllo."

Da allora, OpenAI è salita a diventare una delle aziende più preziose al mondo, preparando, secondo quanto riferito, un'IPO potenzialmente da trilioni di dollari. Nel frattempo, Altman sta guidando un'enorme espansione dell'infrastruttura dell'intelligenza artificiale, con alcuni sforzi che si estendono in regimi autoritari all'estero. OpenAI sta anche perseguendo grandi contratti governativi e stabilendo gradualmente standard per le applicazioni di intelligenza artificiale nell'applicazione dell'immigrazione, nella sorveglianza domestica e nelle armi autonome nelle zone di conflitto.

Sam Altman ha guidato la crescita di OpenAI dipingendo continuamente una grande visione del futuro. In un post sul blog del 2024, ha scritto: "Le vittorie mozzafiato — risolvere il cambiamento climatico, stabilire colonie extraterrestri, scoprire tutte le leggi fisiche — diventeranno tutte eventualmente banali." Questa narrazione sostiene una delle startup che bruciano più velocemente nella storia, fortemente dipendente da finanziamenti provenienti da partner altamente indebitati. L'economia degli Stati Uniti è sempre più dipendente da un pugno di aziende di intelligenza artificiale ad alto leverage, con molti esperti — incluso lo stesso Altman a volte — che avvertono di un rischio bolla nel settore. "Qualcuno perderà molti soldi," ha detto ai giornalisti l'anno scorso. Se la bolla scoppia, potrebbe innescare una catastrofe economica; eppure, se le sue previsioni più ottimistiche si avverano, potrebbe anche diventare uno degli individui più ricchi e potenti a livello globale.

In una chiamata tesa dopo il licenziamento di Altman, il consiglio ha richiesto che egli riconoscesse un modello di comportamento ingannevole. Secondo fonti presenti, ha ripetutamente detto: "Questo è ridicolo," e ha affermato: "Non posso cambiare chi sono." Altman ha successivamente dichiarato di non ricordare quella conversazione. "Penso che forse quello che stavo cercando di dire fosse più simile a: 'Ho sempre cercato di essere un unificatore,'" ci ha spiegato in seguito, attribuendo il suo successo nella guida di un'azienda incredibilmente di successo a questo tratto. Ha attribuito queste critiche a una tendenza nella sua carriera iniziale a "evitare troppo il conflitto." Un membro del consiglio, tuttavia, ha offerto un'interpretazione nettamente diversa: "Quello che intendeva realmente era — 'Ho questa cosa per cui mentirò alle persone, e non smetterò.'"

Deviazione della Missione: Da Sicurezza-Primario a Business-Primario

E così, è emersa una domanda più fondamentale: Quei colleghi che spingevano per la sua destituzione agivano per eccesso di zelo e animosità personale, o il loro giudizio era valido, e Altman era davvero inaffidabile?

Una mattina d'inverno di quest'anno, abbiamo incontrato Altman presso la sede di OpenAI a San Francisco, una delle più di una dozzina di conversazioni che abbiamo condotto per questo articolo. L'azienda si era recentemente trasferita in due torri di vetro di undici piani, una delle quali aveva precedentemente ospitato un altro gigante tecnologico, Uber. Il co-fondatore e ex CEO di Uber, Travis Kalanick, era stato visto come un imprenditore geniale inarrestabile fino a quando non fu costretto a lasciare nel 2017, anche per questioni etiche. (Kalanick ora gestisce una startup di robotica; ha detto che nel suo tempo libero utilizza ChatGPT di OpenAI per “esplorare le frontiere della fisica quantistica.”)

Un dipendente ci ha fatto fare un tour degli spazi dell'ufficio. In un'area piena di lunghi tavoli condivisi e luce naturale, c'era un dinamico dipinto digitale del informatico Alan Turing, i cui occhi ci seguivano mentre ci muovevamo. L'installazione era chiaramente un omaggio al “Test di Turing”—l'esperimento mentale del 1950 per determinare se una macchina può imitare in modo convincente un essere umano. (In uno studio del 2025, le prestazioni di ChatGPT in questo test hanno effettivamente superato quelle dei veri esseri umani.) Normalmente, il dipinto era interattivo. Ma la nostra guida ha spiegato che la sua funzione vocale era stata disabilitata perché stava costantemente “ascoltando” le conversazioni tra i dipendenti e interveniva frequentemente. Altrove nell'ufficio, erano visibili cartelli con la scritta “Senti l'AGI”—uno slogan originariamente coniato da Ilya Sutskever per ricordare ai colleghi i rischi dell'intelligenza artificiale generale avanzata (il punto in cui le macchine raggiungono la capacità cognitiva a livello umano). Dopo il Blip, era evoluto in un allegro motto che celebrava un futuro prospero.

In una sala conferenze anonima all'ottavo piano, abbiamo trovato Sam Altman. “Sentivo parlare di affaticamento decisionale, e non lo capivo mai,” ha detto. “Ora indosso un maglione grigio e jeans ogni giorno, e anche scegliere quale maglione grigio prendere dall'armadio, mi fa pensare, vorrei non dover prendere questa decisione.”

Altman sembrava perpetuamente giovane, con una corporatura snella, occhi blu distanziati, capelli leggermente disordinati, ma aveva quarant'anni. Lui e Oliver Mulherin hanno un figlio di un anno tramite surrogato. “Penso che essere Presidente degli Stati Uniti sia certamente più pressante, ma di tutti i lavori che penso di poter realisticamente fare, questo è quello che potrei immaginare essere il più pressante,” ha detto, guardando uno di noi, poi l'altro. “L'ho descritto agli amici in questo modo: ‘È il lavoro più interessante del mondo fino al giorno in cui abbiamo lanciato ChatGPT.’ Prima di allora, stavamo facendo queste enormi scoperte scientifiche—pensavo fosse una delle scoperte scientifiche più importanti degli ultimi decenni.” Guardò in basso. “Ma da quando è stato lanciato ChatGPT, tutte le decisioni sono diventate molto difficili.”

Altman è cresciuto a Clayton, Missouri, un sobborgo benestante di St. Louis, come il maggiore di quattro figli. Sua madre, Connie Gibstine, è una dermatologa, e suo padre, Jerry Altman, era un agente immobiliare che lavorava anche a iniziative abitative. È stato cresciuto in un tempio ebraico riformato, ha frequentato una scuola preparatoria privata e in seguito l'ha descritta come "non un luogo facile per dichiararsi gay." Tuttavia, nel complesso, la comunità della classe medio-alta in cui si trovava era relativamente liberale.

Intorno all'età di sedici o diciassette anni, ha subito un grave assalto fisico e insulti omofobici mentre era fuori di notte in un quartiere gay di St. Louis. Altman non ha denunciato l'incidente ed era riluttante a fornire ulteriori dettagli, affermando che un resoconto più completo "mi farebbe sembrare che stessi manipolando le persone o cercando simpatia." Ha minimizzato questa esperienza e l'importanza della sua orientazione sessuale nella sua identità. Ma ha anche riconosciuto: "Probabilmente c'è qualcosa di molto profondo qui psicologicamente, riguardo al sentire di essermi dichiarato ma in realtà non lo fossi—per evitare ulteriori conflitti."

Suo fratello ha descritto la sua personalità infantile come "Devo vincere e devo controllare tutto," in un'intervista con The New Yorker nel 2016. Altman ha poi frequentato l'Università di Stanford e ha partecipato frequentemente a giochi di poker fuori dal campus. "Sento di aver imparato di più sulla vita e sugli affari lì che non al college."

Era Y Combinator: Iperbole e Controversia sulla Fiducia

Gli studenti di Stanford sono ambiziosi, ma i più orientati all'azione tra loro spesso scelgono di abbandonare gli studi. Alla fine del suo secondo anno, Altman si è diretto in Massachusetts per unirsi al primo gruppo di imprenditori nel programma di incubazione startup di Y Combinator. L'istituzione è stata co-fondata dal rinomato ingegnere del software Paul Graham. Ogni partecipante si è unito con un'idea di startup. (Tra quelli nel suo gruppo c'erano i team che in seguito fondarono Reddit e Twitch.) Il progetto di Altman è stato successivamente chiamato Loopt, un prodotto di social networking precoce che permetteva agli amici di vedere dove si trovavano gli altri tracciando la posizione dei loro telefoni accesi. L'azienda ha messo in mostra sia le sue capacità esecutive sia la sua tendenza a ritagliarsi uno spazio per sé nelle aree grigie. All'epoca, le normative federali richiedevano ai gestori di essere in grado di localizzare la posizione di un telefono in situazioni di emergenza, e Altman ha stipulato accordi con i gestori per incorporare questa funzionalità nel suo prodotto.

La maggior parte dei dipendenti durante l'era di Loopt apprezzava Sam Altman, ma alcuni erano colpiti dalla sua tendenza a "esagerare" anche su questioni banali. Alcuni ricordavano Altman vantarsi di essere un campione di ping-pong "come il campione di ping-pong delle scuole superiori del Missouri", solo per essere uno dei peggiori giocatori dell'azienda. (Altman ha detto che probabilmente era solo uno scherzo.) Un dipendente più anziano di Loopt, Mark Jacobstein, fu nominato dagli investitori per servire come "custode" di Altman, e in seguito commentò nella biografia di Keach Hagey, "L'ottimista": "C'è un'area grigia tra 'Penso di poterlo fare' e 'L'ho fatto', e nella sua forma più estrema, questa vaghezza può portare a risultati come quelli di Theranos."

Secondo Hagey, a causa delle preoccupazioni sullo stile di leadership di Altman e sulla mancanza di trasparenza, alcuni dipendenti senior di Loopt suggerirono due volte al consiglio di rimuoverlo dalla posizione di CEO. Tuttavia, allo stesso tempo, aveva anche un forte fascino personale. Un ex dipendente ricordava che un membro del consiglio rispose direttamente: "Questa è l'azienda di Sam, torna a fare il tuo lavoro." (Tuttavia, alcuni membri del consiglio negarono anche che questi tentativi di rimozione fossero seri.)

Loopt non ha mai visto miglioramenti nella crescita degli utenti ed è stata infine acquisita da una società fintech nel 2012. Secondo fonti interne, questa acquisizione serviva principalmente ad aiutare Altman a "uscire con grazia." Tuttavia, nel 2014, quando Paul Graham si ritirò da Y Combinator, scelse comunque Altman come suo successore. "Gli ho chiesto nella mia cucina," disse Graham a Il New Yorker, "Sorrise come se tutto fosse andato al suo posto. Non ho mai visto il sorriso incontrollabile di Sam, come quello che mostri quando lanci una pallina di carta lontano nel cestino.

La nuova posizione rese Altman, allora 28enne, un "kingmaker." Il suo compito era quello di selezionare gli imprenditori più ambiziosi e promettenti, metterli in contatto con i migliori programmatori e investitori, e aiutarli a costruire aziende monopolistiche leader nel settore (nel frattempo, Y.C. avrebbe preso il 6% o il 7% di equity).

Sotto la sua guida, Y Combinator si espanse rapidamente, con il numero di progetti incubati che crebbe da decine a centinaia. Ma alcuni investitori della Silicon Valley iniziarono a credere che i suoi interessi non fossero completamente allineati. Un investitore ci ha detto che Altman "investirebbe selettivamente in modo personale nelle aziende di massima qualità per escludere investitori esterni" (Altman ha negato questa affermazione). Ha anche agito come scout per Sequoia Capital, partecipando a investimenti in progetti in fase iniziale e ricevendo alcuni ritorni.

Secondo fonti, quando Altman investì nella società fintech Stripe come investitore angel, insistette per ottenere una percentuale più alta di azioni, una pratica che scontentò internamente Sequoia. La fonte ha commentato che questo rifletteva una strategia "Sam-prima". (Altman ha negato questa affermazione. Ha investito circa 15.000 dollari in Stripe intorno al 2010, detenendo circa il 2% delle azioni, e l'azienda è ora valutata oltre 150 miliardi di dollari.) Altman ha affermato di aver investito in circa 400 aziende.

Entro il 2018, diversi partner di Y Combinator erano insoddisfatti del comportamento di Altman e lo hanno segnalato a Graham. Successivamente, Graham ha avuto una conversazione franca con sua moglie e co-fondatrice di Y.C., Jessica Livingston, e Altman. Dopo, Graham ha iniziato a dichiarare pubblicamente che, sebbene Altman avesse concordato verbalmente di lasciare, in pratica non si era effettivamente dimesso.

Altman ha informato alcuni partner che si sarebbe dimesso da presidente ma sarebbe rimasto come presidente del consiglio. Nel maggio 2019, Y Combinator ha pubblicato un post sul blog annunciando il nuovo presidente, con una nota che affermava: "Sam sta passando a presidente di YC." Pochi mesi dopo, questa dichiarazione è stata rivista in "Sam Altman si è dimesso da qualsiasi ruolo operativo in YC," e poi questa frase è stata completamente rimossa. Tuttavia, a partire dal 2021, Altman era ancora elencato come Presidente di Y Combinator nella U.S. asset/recharge">Depositi della Securities and Exchange Commission. (Altman ha detto che ha appreso di questo solo in seguito.)

Sam Altman ha costantemente dichiarato pubblicamente nel corso degli anni e in recente testimonianza legale che non è stato licenziato da Y Combinator e ci ha detto che non ha resistito alla partenza. Paul Graham ha twittato: "Non volevamo che se ne andasse, ma volevamo che scegliesse tra YC e OpenAI." In una dichiarazione, Graham ci ha anche detto: "Non abbiamo il potere legale di licenziare nessuno; tutto ciò che possiamo fare è applicare pressione morale."

Tuttavia, in privato, la storia era più esplicita: la partenza di Altman derivava da una mancanza di fiducia da parte dei partner di YC. Questo racconto del tempo di Altman a Y Combinator si basa su interviste con diversi fondatori e partner di YC e materiali contemporanei, tutti i quali suggeriscono che la separazione non fosse del tutto reciproca. Graham ha persino riferito di aver detto ai colleghi di YC in una discussione interna che "Sam ci aveva mentito per tutto il tempo prima di essere licenziato."

La Mission Drift di OpenAI: Da Safety-First a Profit-First

Nel maggio 2015, Altman ha inviato un'email a Elon Musk, che all'epoca era circa la 100ª persona più ricca al mondo. Come molti imprenditori della Silicon Valley, Musk era allora fortemente concentrato su una serie di quelli che considerava "rischi esistenziali", anche se la maggior parte degli altri li vedeva come possibilità remote. "Dobbiamo essere super attenti con l'IA," ha scritto su Twitter, "Potenzialmente più pericolosa delle armi nucleari."

Altman, che era stato a lungo un ottimista tecnologico, ha rapidamente cambiato il suo tono sull'IA in uno più apocalittico. In dichiarazioni pubbliche e comunicazioni private con Musk e altri, ha avvertito contro il permettere che questa tecnologia venga monopolizzata da giganti tecnologici guidati dal profitto. "Mi sono chiesto se ci sia un modo per fermare la corsa agli armamenti dell'IA," ha scritto, "ma se non c'è modo, allora sembra che sarebbe meglio avere la giusta azienda a farlo." Richiamando l'analogia nucleare, ha proposto di stabilire un "A.I. Progetto Manhattan." Ha ulteriormente delineato i principi fondamentali di questa organizzazione: "La sicurezza deve essere la massima priorità"; "Certamente dovremmo seguire e sostenere tutte le regolamentazioni."

Successivamente, lui e Musk hanno deciso il nome del progetto: OpenAI.

A differenza del Progetto Manhattan, che era inizialmente guidato dal governo e culminò nella creazione della bomba atomica, OpenAI sarebbe stata finanziata privatamente nelle sue fasi iniziali. Altman prevedeva che una volta emersa una forma di "superintelligenza" che supera l'intelligenza artificiale generale (AGI), avrebbe generato abbastanza valore economico da "catturare il cono di luce futuro dell'universo." Tuttavia, ha anche ripetutamente sottolineato i suoi potenziali rischi esistenziali: a un certo punto, l'impatto della tecnologia sulla sicurezza nazionale potrebbe essere così significativo da costringere il governo degli Stati Uniti a prendere il controllo di OpenAI, persino a nazionalizzarlo, e a trasferire le sue strutture in una base sicura nel deserto. Entro la fine del 2015, Musk era stato convinto. "Dovremmo annunciare un impegno di finanziamento di 1 miliardo di dollari," ha scritto, "e io lo sosterrò se altri non lo faranno."

Sam Altman ha inizialmente posto OpenAI sotto il braccio nonprofit di Y Combinator e l'ha inquadrato come un progetto filantropico interno. Ha allocato azioni di YC ai membri che si univano a OpenAI e ha trasferito fondi di donazione attraverso i conti di YC. A un certo punto, questo laboratorio si è persino affidato al supporto di un fondo YC in cui Altman aveva partecipazioni personali. (Altman in seguito si riferì a questa partecipazione azionaria come "negligenza" e dichiarò che le azioni di YC allocate ai dipendenti provenivano dalle sue partecipazioni personali.)

L'analogia con il "Progetto Manhattan" si manifestò anche nella corsa ai talenti. Simile alla ricerca sulla fissione nucleare, l'apprendimento automatico era allora un campo scientifico su piccola scala con un potenziale impatto epocale, guidato da un piccolo gruppo di individui distintamente talentuosi. Elon Musk, Altman e Greg Brockman, che si unì da Stripe, credevano tutti che i veri scienziati informatici innovativi fossero rari. Google, d'altra parte, aveva un enorme vantaggio in termini di finanziamenti e tempo. "Siamo enormemente indietro in termini di manodopera e risorse, il divario è surreale," scrisse Musk in seguito in un'email. Ma credeva anche che "se possiamo continuare ad attrarre i migliori talenti e garantire la giusta direzione, OpenAI prevarrà ancora."

Uno degli obiettivi di reclutamento più importanti era Ilya Sutskever—un ricercatore introverso e intenso spesso considerato uno dei più dotati scienziati dell'IA del suo tempo. Nato nell'Unione Sovietica nel 1986, Sutskever aveva una linea di capelli che si ritirava, occhi profondi e l'abitudine di fermarsi e fissare contemplativamente prima di parlare. Un'altra figura chiave era Dario Amodei, un ricercatore ad alta energia con un background in biofisica che spesso si passava nervosamente la mano tra i capelli neri nei momenti di tensione e rispondeva con saggi di più paragrafi anche a email di una sola frase. Entrambi occupavano posizioni ben retribuite in altre aziende all'epoca, ma Altman investì notevoli sforzi per portarli a bordo. In seguito scherzò: "Praticamente stavo 'inseguiendo' Ilya."

Mentre Musk potrebbe avere una maggiore notorietà, Altman è l'operatore più scorrevole. Prese l'iniziativa di inviare un'email ad Amodei e organizzare un incontro one-to-one in un ristorante indiano. (Altman: "La mia Uber ha avuto un incidente! Potrei arrivare con 10 minuti di ritardo." Amodei: "Oh no, spero tu stia bene.") Come molti ricercatori di IA, Amodei crede che questa tecnologia debba essere sviluppata solo una volta dimostrato che è "allineata" con i valori umani—significa che non devia catastroficamente dall'intento umano, come sterminare l'umanità in nome della "pulizia dell'ambiente." Altman ripeté più volte questa preoccupazione per la sicurezza nella loro conversazione, instillando fiducia.

Amodei, che in seguito si unì all'azienda, trascorse anni a documentare le azioni di Altman e Brockman, raccogliendole in un documento intitolato "La mia esperienza in OpenAI" (sottotitolo: "Riservato:" Non distribuire"). Oltre duecento pagine di documenti relativi ad Amodei—compresi questi appunti, email interne e memo—circolarono all'interno dei circoli della Silicon Valley ma non erano mai stati divulgati pubblicamente. In questi documenti, Amodei scrisse che l'obiettivo di Altman era creare "un laboratorio di intelligenza artificiale incentrato sulla sicurezza ('forse non all'inizio, ma subito dopo')."

Nel dicembre 2015, poche ore prima dell'annuncio ufficiale di OpenAI, Altman inviò un'email a Musk menzionando una voce: Google "stava per presentare un'enorme offerta inversa a tutti in OpenAI domani, cercando di distruggere l'organizzazione completamente." Musk chiese, "Ilya ha dato una risposta definitiva?" Altman rispose dicendo che Sutskever era risoluto. Infatti, Google aveva offerto a Sutskever uno stipendio annuale di 6 milioni di dollari, che OpenAI non poteva eguagliare. Eppure Altman rimase fiducioso, affermando: "Peccato che non siano dalla parte del 'fare la cosa giusta'."

Elon Musk fornì una volta uno spazio ufficio per OpenAI in una vecchia fabbrica di valigie nel quartiere Mission di San Francisco. Come ci ha detto Ilya Sutskever, il grido di battaglia principale per i dipendenti all'epoca era: "Voi tutti salverete il mondo." Se tutto fosse andato bene, i fondatori di OpenAI credevano che l'intelligenza artificiale avrebbe inaugurato un'utopia "post-scarsità": automatizzando il lavoro arduo, curando il cancro, concedendo agli esseri umani più tempo libero e abbondanza. Ma se la tecnologia dovesse andare fuori controllo o finire nelle mani sbagliate, la distruzione potrebbe essere totale—come essere utilizzata per sviluppare nuove armi biologiche o sciami di droni avanzati; i modelli potrebbero superare la supervisione umana, auto-replicarsi su server clandestini oltre lo spegnimento; in casi estremi, potrebbero persino prendere il controllo della rete elettrica, del mercato azionario o dell'arsenale nucleare.

Sebbene non tutti concordino con queste valutazioni, Sam Altman ha ripetutamente espresso la sua convinzione in questo rischio. In un post sul blog del 2015, scrisse che l'intelligenza artificiale a livello sovrumano "non ha bisogno di essere malvagia per distruggere l'umanità, potrebbe semplicemente essere indifferente, mentre si occupa di raggiungere altri obiettivi... spazzandoci via casualmente." Il co-fondatore di OpenAI si impegnò a non dare priorità alla velocità rispetto alla sicurezza, e lo statuto dell'azienda include un impegno legale a "beneficiare tutta l'umanità." Sono anche preoccupati che se l'IA diventa la tecnologia più potente di sempre, qualsiasi singolo controllore acquisirebbe un potere senza precedenti—uno scenario che definiscono "dittatura AGI."

Dopo la partenza di Musk, ricercatori come Dario Amodei iniziarono a esprimere insoddisfazione per lo stile di gestione di Greg Brockman, con alcuni che lo trovavano autoritario, mentre Sutskever era descritto come "principiato ma carente in capacità organizzative." Durante la sua transizione a CEO, Altman sembrava fare diversi impegni verso varie fazioni all'interno dell'azienda. Assicurò ad alcuni ricercatori che avrebbe indebolito l'autorità di Brockman, ma allo stesso tempo raggiunse un "accordo di stretta di mano" con Brockman e Sutskever: sarebbe stato CEO, ma si sarebbe dimesso se entrambi lo avessero richiesto. (Altman contesta questa affermazione, dichiarando di essere stato invitato a diventare CEO.) I tre riconoscono l'esistenza dell'accordo, con Brockman che afferma che era informale: "Ha detto unilateralmente che se noi due avessimo chiesto, si sarebbe dimesso." In realtà, ci siamo opposti a questa idea, ma disse che era importante per lui e che era fatto per altruismo.") Successivamente, il consiglio apprese che il CEO aveva effettivamente istituito un "consiglio ombra" per se stesso, il che fu uno shock.

I documenti interni mostrano che il team fondatore aveva dubbi sulla struttura nonprofit già nel 2017. Quello stesso anno, dopo che Musk tentò un'acquisizione, Brockman scrisse in un diario: "Non posso dire che ci siamo davvero attenuti a essere una nonprofit..." Se diventiamo una B-Corp in tre mesi, le dichiarazioni precedenti erano bugie." Amodei documentò anche in appunti iniziali di aver chiesto a Brockman quali fossero le sue massime priorità, a cui rispose "denaro e potere." (Brockman nega questa affermazione.) Il suo diario rivela anche una mentalità contraddittoria: da un lato affermando "se gli altri non sono ricchi, non mi interessa essere ricco nemmeno io," e dall'altro chiedendosi "cosa voglio davvero?" con una risposta che è "raggiungere finanziariamente 1 miliardo di dollari."

Nel 2017, Sutskever lesse un articolo di ricerca di ricercatori di Google in ufficio che proponeva una "nuova semplice architettura di rete—il Trasformatore." Saltò dalla sedia, corse nel corridoio e urlò: "Fermate tutto ciò che state facendo, questa è la risposta." Per lui, questa architettura avrebbe permesso a OpenAI di addestrare modelli più complessi. Questa scoperta portò ai primi modelli di Trasformatore generativo pre-addestrati e servì da base per ChatGPT in seguito.

Altman si era precedentemente impegnato con i primi dipendenti che OpenAI sarebbe sempre rimasta pura nella sua natura nonprofit, portando molti programmatori ad accettare significativi tagli salariali per unirsi all'azienda. OpenAI ricevette anche circa 30 milioni di dollari in donazioni, inclusa quella dall'organizzazione Open Philanthropy, un hub di finanziamento chiave nel movimento dell'altruismo efficace, che ha a lungo sostenuto progetti come la distribuzione di zanzariere in aree impoverite.

Le operazioni quotidiane erano principalmente supervisionate da Brockman e Sutskever, mentre Musk e Altman rimanevano occupati con le loro rispettive altre imprese, visitando tipicamente l'azienda una volta a settimana. Entro settembre 2017, Musk stava diventando impaziente. Mentre si discuteva la possibilità di trasformare OpenAI in un'azienda a scopo di lucro, richiese il controllo maggioritario.

Le risposte di Altman variavano in diverse occasioni, ma una cosa su cui insisteva costantemente era che, se l'azienda dovesse ristrutturarsi sotto un CEO, quella posizione dovrebbe essere ricoperta da lui. Sutskever era visibilmente a disagio riguardo a questo. A nome suo e di Brockman, inviò un lungo email a Musk e Altman intitolato "Pensieri Onesti", affermando: "L'obiettivo di OpenAI è rendere il futuro migliore e evitare la dittatura dell'AGI." Rivolgendosi a Musk, scrisse: "Pertanto, impostare una struttura che potrebbe farti diventare un dittatore è una cattiva idea." Espresse anche preoccupazioni simili ad Altman, affermando: "Non riusciamo a capire perché il titolo di CEO sia così cruciale per te." Le tue ragioni continuano a cambiare, rendendo difficile per noi vedere la vera motivazione.

"Signori, ho finito," rispose Musk, "O fate qualcos'altro da soli o continuate a mantenere lo status nonprofit di OpenAI—altrimenti, vi sto solo finanziando gratuitamente per gestire una startup." Cinque mesi dopo, se ne andò con evidente insoddisfazione. (Nel 2023, fondò il concorrente a scopo di lucro xAI. L'anno successivo, citò in giudizio Altman e OpenAI per frode e violazione della fiducia caritatevole, sostenendo di essere stato "manipolato con attenzione" e che Altman avesse intrapreso un "lungo inganno" utilizzando le sue preoccupazioni sui rischi dell'IA per ottenere finanziamenti. La causa è in corso, con OpenAI che respinge fermamente le accuse.)

Con l'avanzare delle capacità tecnologiche, abbiamo appreso che circa una dozzina di ingegneri chiave di OpenAI avevano tenuto una serie di incontri segreti, discutendo privatamente se il team fondatore, compresi Sam Altman e Greg Brockman, potesse essere fidato. Durante uno di questi incontri, un dipendente ricordò uno sketch satirico del duo comico britannico Mitchell e Webb—un soldato nazista sul fronte orientale ha improvvisamente un'epifania, chiedendo: "Siamo noi i cattivi?"

Entro il 2018, Dario Amodei aveva iniziato a mettere in discussione pubblicamente le motivazioni dei fondatori. In seguito scrisse in una nota: "Tutto sembra un piano di finanziamento senza fine. Sento che ciò di cui OpenAI ha realmente bisogno è una chiara definizione: cosa vuole fare, cosa non vuole fare e come la sua esistenza renderà il mondo migliore." Nonostante l'azienda avesse già una dichiarazione di missione — "assicurare che l'intelligenza artificiale generale benefici tutta l'umanità" — Amodei sentiva che questa dichiarazione non fosse chiara per il team esecutivo.

All'inizio del 2018, iniziò a redigere lo statuto dell'azienda e, dopo settimane di discussione con Altman e Brockman, si adoperò per includere una delle clausole più radicali: se un "progetto allineato ai valori e attento alla sicurezza" fosse stato più vicino a raggiungere l'AGI rispetto a OpenAI, l'azienda avrebbe "cessato la competitività e invece assistito quel progetto." Questa era nota come la clausola "unisciti e assisti" — per esempio, se Google dovesse raggiungere per primo un'AGI sicura, OpenAI si dissolverebbe teoricamente e trasferirebbe risorse a Google. Da una prospettiva aziendale tradizionale, questo impegno era quasi impensabile, ma OpenAI non ha mai inteso diventare un'azienda tradizionale.

Questa premessa ha affrontato un controllo della realtà nella primavera del 2019. In quel momento, OpenAI era in trattative con Microsoft per un potenziale investimento fino a 1 miliardo di dollari. Sebbene Amodei (allora a capo del team di sicurezza) fosse stato coinvolto nella presentazione del progetto a Bill Gates, c'era ancora ansia all'interno del team che Microsoft potesse introdurre termini che avrebbero diluito gli impegni etici di OpenAI. Amodei ha presentato a Altman un elenco prioritario di requisiti di sicurezza, con la clausola "unire e assistere" in cima.

Altman ha concordato in quel momento. Tuttavia, mentre l'accordo si avvicinava al completamento a giugno, Amodei ha scoperto una nuova clausola nell'accordo che dava a Microsoft il potere di veto sulla fusione di OpenAI. "Questo equivaleva a una violazione dell'80% della carta," ha ricordato poi. Ha affrontato Altman riguardo a questo, con Altman che inizialmente negava l'esistenza di tale clausola. Amodei ha letto il contratto parola per parola sul posto, dovendo infine far confermare direttamente un altro collega con Altman. (Altman ha dichiarato di non ricordare questo incidente.)

Esodo di Sicurezza e la Nascita di Anthropic

Le note di Amodei documentavano anche una serie di conflitti tesi in aumento. In una riunione diversi mesi dopo, Altman ha convocato lui e sua sorella Daniela, che lavorava anche sulla sicurezza e le politiche dell'azienda, affermando di aver ricevuto informazioni affidabili da un "dirigente senior" secondo cui i due stavano pianificando un "colpo di stato." Le note affermavano che Daniela era diventata "emotivamente sopraffatta" sul posto e ha chiamato il dirigente, che ha poi negato di aver mai detto una cosa del genere. Fonti a conoscenza della questione hanno ricordato che Altman ha poi negato di aver mai fatto questa accusa: "Non l'ho mai detto." Daniela ha risposto: "Lo hai appena fatto." (Altman ha dichiarato che il suo ricordo era leggermente diverso, affermando di aver accusato Amodei di impegnarsi in "comportamenti politici.") Nel 2020, Amodei, Daniela e diversi colleghi hanno lasciato l'azienda per fondare Anthropic, che da allora è diventata uno dei principali concorrenti di OpenAI.

Nel frattempo, Altman ha continuato a sottolineare l'impegno di OpenAI per la sicurezza, specialmente in presenza di potenziali reclute. Alla fine del 2022, quattro scienziati informatici hanno pubblicato un documento che proponeva il rischio di "allineamento ingannevole": modelli altamente avanzati potrebbero funzionare bene durante i test ma perseguire i propri obiettivi dopo il reale impiego. (Questo scenario apparentemente fantascientifico si è già verificato in determinate condizioni sperimentali.) Diverse settimane dopo la pubblicazione dell'articolo, uno degli autori—uno studente di dottorato all'Università della California, Berkeley—ricevette un'email da Altman. Altman espresse crescenti preoccupazioni riguardo alla minaccia dell'"IA non allineata" e contemplò di investire 1 miliardo di dollari per affrontare questo problema, come ad esempio istituire un premio di ricerca globale. Nonostante questo studente avesse sentito voci che "Sam era un po' scivoloso," l'impegno alla fine lo convinse a sospendere i suoi studi e unirsi a OpenAI.

Tuttavia, durante diversi incontri nella primavera del 2023, l'atteggiamento di Altman sembrò cambiare. Non menzionò più l'istituzione di un premio, ma si concentrò invece sulla creazione di un "team di superallineamento" interno all'azienda. Un annuncio ufficiale dichiarò che il team avrebbe ricevuto il "20% del calcolo sicuro dell'azienda," una risorsa valutata potenzialmente oltre 1 miliardo di dollari. L'annuncio sottolineò anche che se il problema dell'allineamento non potesse essere risolto, l'AGI potrebbe portare a "umanità disempowered o addirittura estinta." Jan Leike, che era responsabile del team, dichiarò in seguito: "Era davvero una strategia di retention molto efficace."

Tuttavia, la promessa del "20% di calcolo" non fu mantenuta. Quattro individui coinvolti o che seguivano da vicino il team dichiararono che le risorse effettivamente allocate rappresentavano solo l'1% o il 2% del calcolo totale dell'azienda. Inoltre, un ricercatore sottolineò che "la maggior parte del cosiddetto calcolo di superallineamento in realtà gira sul cluster più vecchio e con le peggiori prestazioni." I membri del team credevano generalmente che hardware più avanzato fosse prioritizzato per progetti che generano entrate. (OpenAI lo negò.) Leike aveva sollevato questa questione con l'allora Chief Technology Officer Mira Murati, ma la risposta fu che non c'era bisogno di insistere ulteriormente—questo impegno era "irrealistico" fin dall'inizio.

In questo periodo, un ex dipendente ci disse che Ilya Sutskever "iniziò a enfatizzare fortemente la sicurezza." Nei primi giorni di OpenAI, mentre pensava che il rischio catastrofico fosse una preoccupazione ragionevole, era ancora piuttosto distante; tuttavia, man mano che cominciò a credere che l'AGI si stesse avvicinando, questa preoccupazione aumentò rapidamente. Secondo il ricordo dell'impiegato, durante una riunione generale, "Ilya si alzò e disse che ci sarebbe stato un momento nei prossimi anni in cui quasi tutti in azienda avrebbero dovuto passare a occuparsi di sicurezza, altrimenti siamo finiti." Tuttavia, l'anno successivo, questo "team di superallineamento" fu sciolto prima di completare la sua missione.

A questo punto, le comunicazioni interne indicano che i dirigenti e i membri del consiglio stanno iniziando a credere che il comportamento di occultamento e inganno di Sam Altman possa avere un impatto materiale sulla sicurezza dei prodotti di OpenAI. Durante una riunione nel dicembre 2022, Altman assicurò al consiglio che le molteplici caratteristiche del prossimo GPT-4 erano state approvate dal comitato per la sicurezza. La membro del consiglio e esperta di politiche sull'IA, Helen Toner, richiese di vedere i documenti pertinenti, ma scoprì che le due caratteristiche più controverse—una che consentiva agli utenti di "affinare" il modello e un'altra che ne permetteva l'uso come assistente personale—non erano state effettivamente approvate. Dopo la riunione, un'altra membro del consiglio, l'imprenditrice Tasha McCauley, fu messa da parte da un dipendente che le chiese se fosse a conoscenza "dell'incidente di conformità in India": Altman non aveva mai menzionato in molteplici aggiornamenti al consiglio che Microsoft aveva lanciato una versione preliminare di ChatGPT in India senza completare le necessarie revisioni di sicurezza. "Questo è stato quasi interamente messo a tacere," disse l'allora ricercatore di OpenAI Jacob Hilton.

Sebbene questi problemi non abbiano portato direttamente a un incidente di sicurezza, la ricercatrice Carroll Wainwright credeva che riflettessero una tendenza di "slittamento continuo verso un prodotto-prima, sicurezza-leggera". Dopo il rilascio di GPT-4, Jan Leike, che era responsabile del lavoro sulla sicurezza, scrisse al consiglio: "OpenAI si sta allontanando dalla sua missione. Prioritizziamo prima il prodotto e il fatturato, poi la capacità, la ricerca e la scalabilità, con allineamento e sicurezza al terzo posto." Notò anche che "aziende come Google stanno imparando lezioni—accelerando il rilascio trascurando le preoccupazioni per la sicurezza."

In un'email ai membri del consiglio, McCauley scrisse: "Credo che siamo effettivamente in una fase in cui è necessaria una maggiore supervisione." Tuttavia, quando il consiglio tentò di affrontare questo problema, erano chiaramente in svantaggio. "Per dirla in modo diretto, è un gruppo di persone che manca di esperienza nel mondo reale," disse l'ex membro del consiglio Sue Yoon. Nel 2023, l'azienda si stava preparando a rilasciare GPT-4 Turbo. Secondo la descrizione di Sutskever in un promemoria, Altman aveva detto a Mira Murati che il modello non richiedeva approvazione per la sicurezza e attribuì questa decisione al consulente legale dell'azienda, Jason Kwon. Ma quando Murati chiese a Kwon su Slack, lui rispose: "Um... Non sono del tutto sicuro del perché Sam penserebbe questo." (OpenAI dichiarò che questo incidente non era "significativo.")

Poco dopo, il consiglio decise di licenziare Altman—successivamente, il mondo assistette a come egli invertì rapidamente quella decisione. Lo statuto di OpenAI è ancora disponibile sul sito ufficiale, ma coloro che conoscono i documenti di governance dell'azienda affermano che i suoi contenuti sono stati diluiti fino a diventare quasi privi di significato. Nel giugno dello scorso anno, Altman scrisse in un post personale sul blog riguardo alla superintelligenza: "Abbiamo attraversato l'orizzonte degli eventi; il decollo è iniziato."

Secondo lo statuto originale, questo doveva essere un punto di svolta per l'azienda per cessare la competizione e passare alla collaborazione. Tuttavia, nell'articolo intitolato "La Gentile Singolarità," ha adottato un tono completamente nuovo, sostituendo "angoscia esistenziale" con "immaginazione ottimista": "Avremo tutti cose migliori, e creeremo cose sempre migliori l'uno per l'altro." Ha riconosciuto che i problemi di allineamento rimanevano irrisolti ma li ha ridefiniti come una "seccatura," simile all'essere dipendenti da un algoritmo di raccomandazione di Instagram.

Altman è spesso descritto con ammirazione o scetticismo come "il narratore più potente della sua generazione." Il Steve Jobs che ammirava era un tempo considerato in possesso di un "campo di distorsione della realtà," modellando il mondo secondo la sua visione con assoluta fiducia. Ma anche Jobs non ha mai detto agli utenti: se non comprano il suo prodotto, l'umanità potrebbe perire. Nel 2008, a soli 23 anni, Altman è stato descritto dal suo mentore Paul Graham come segue: "Lasciatelo su un'isola di cannibali, tornate dopo cinque anni, e sarà re." Questa valutazione non si basava sui suoi successi dell'epoca ma sulla sua volontà quasi illimitata.

Tuttavia, per alcuni di coloro che hanno lavorato più a stretto contatto con lui, questo tratto ha un altro lato. Man mano che Sutskever diventava sempre più ansioso riguardo alla sicurezza dell'IA, ha compilato una serie di memo su Altman e Greg Brockman—un insieme di documenti così significativi nella Silicon Valley che vengono persino chiamati "I Memo di Ilya."

Nel frattempo, Dario Amodei ha continuato a documentare. Questi materiali non fornivano la cosiddetta "prova schiacciante" ma ritraevano una serie di schemi di comportamento apparentemente sparsi ma in accumulo: come offrire la stessa posizione a persone diverse, fornire resoconti contrastanti di informazioni pubbliche e essere ambigui riguardo ai processi di sicurezza. La conclusione di Sutskever era che questo comportamento "non costruisce un ambiente favorevole a un'AGI sicura"; Amodei è stato più diretto, scrivendo, "Il problema con OpenAI è Sam stesso."

Abbiamo intervistato oltre cento persone familiari con l'approccio di Altman: attuali e ex dipendenti e direttori di OpenAI, suoi colleghi e concorrenti, amici e nemici—nella Silicon Valley, molti indossano spesso più cappelli. Alcuni hanno difeso il suo acume imprenditoriale, credendo che Sutskever e Amodei fossero solo concorrenti falliti; altri lo vedevano come uno scienziato ingenuo e distratto, o addirittura come un estremista intrappolato nel "doomsdayism." Yoon credeva che Altman non fosse un "villain machiavellico" ma una persona convinta dalla propria narrativa, "è così immerso nella sua autoconvinzione che prende decisioni incomprensibili nel mondo reale—ma non vive nel mondo reale per cominciare."

Tuttavia, il giudizio della maggior parte degli intervistati è simile a quello di Sutskever e Amodei: Altman ha una volontà di potere estrema, che si distingue anche tra i titani industriali i cui nomi sono incisi sui razzi. "Non è vincolato dalla 'realtà'," ha detto un membro del consiglio, "Possiede due tratti che raramente appaiono insieme: uno è un forte desiderio di essere apprezzato, di compiacere l'altra parte in ogni interazione; l'altro è quasi antisociale, privo di preoccupazione per le conseguenze dell'inganno degli altri."

Più di un intervistato ha usato spontaneamente il termine "personalità antisociale." Altman, un pari del primo gruppo di Y Combinator, era un collega del programmatore Aaron Swartz, che si suicidò nel 2013. Prima della sua morte, Swartz espresse preoccupazioni a un amico riguardo ad Altman: "Devi capire, Sam non è mai da fidarsi. È una personalità antisociale; è capace di qualsiasi cosa." Diversi dirigenti Microsoft hanno anche dichiarato che, nonostante il supporto di lunga data di Satya Nadella per Altman, la relazione tra i due sta diventando tesa. "Ingannerà, distorcerà, rinnegocierà o addirittura annullerà accordi," ha detto un dirigente. All'inizio di quest'anno, OpenAI ha riaffermato Microsoft come fornitore esclusivo di servizi cloud per il suo "modello senza stato", ma lo stesso giorno ha annunciato una partnership da 500 miliardi di dollari con Amazon, rendendo quest'ultima il rivenditore esclusivo della sua piattaforma AI per le imprese. Sebbene questo accordo non violasse il contratto, Microsoft credeva ci fosse un potenziale conflitto. (OpenAI ha dichiarato che non avrebbe violato il contratto.) Il dirigente ha persino commentato: "Credo ci sia una possibilità significativa che in futuro sarà visto come qualcuno simile a Bernie Madoff o Sam Bankman-Fried."

Altman non è un genio tecnico—agli occhi di molti colleghi, le sue capacità professionali nella programmazione o nell'apprendimento automatico sono limitate, e potrebbe persino confondere concetti di base. Ha costruito OpenAI principalmente integrando i fondi e le risorse tecniche di altre persone. Questo non è raro—questo è il ruolo di un imprenditore. Ciò che è più notevole è la sua capacità di persuadere ingegneri, investitori e il pubblico con opinioni contrastanti, convincendoli che le sue priorità sono anche le loro. Quando queste persone cercano di fermarlo, è spesso in grado di disinnescare la situazione con una retorica appropriata—almeno temporaneamente; e quando l'altra parte si rende conto del problema, di solito ha già raggiunto il suo obiettivo. "Progetterà alcune strutture per vincolare il suo futuro sé sulla carta," ha detto Wainwright, "ma quando il futuro arriverà davvero e avrà bisogno di essere vincolato, smonterà queste strutture una ad una."

"La sua persuasione è incredibilmente forte, come un trucco mentale da Jedi," ha detto un dirigente tecnologico che ha lavorato con lui, "È un livello completamente diverso." Nella ricerca sull'allineamento dell'IA, esiste un concetto classico: la volontà dell'umanità contro un'IA potente, con quest'ultima che prevale quasi inevitabilmente, come un grande maestro di scacchi contro un bambino. E secondo la visione di quel dirigente, assistere Altman mentre navigava tra le varie parti durante l'evento "Blip" era come osservare "un'AGI che si libera dalla sua gabbia."

Nei giorni successivi al suo licenziamento, Sam Altman aveva cercato di prevenire qualsiasi indagine sulle accuse contro di lui. Aveva espresso a due persone la sua preoccupazione che anche solo l'esistenza di un'indagine lo avrebbe fatto apparire colpevole. (Altman nega di aver fatto questa affermazione.) Tuttavia, dopo le dimissioni, i membri del consiglio hanno insistito affinché un'"indagine indipendente avesse luogo" come condizione per la sua partenza, e Altman ha infine accettato una "revisione" dei "recenti eventi." Secondo fonti a conoscenza delle negoziazioni, i due nuovi membri del consiglio hanno insistito per guidare questa revisione personalmente.

Lawrence Summers, sfruttando le sue connessioni in politica e a Wall Street, sembrava conferire una certa credibilità a questa revisione. (Lo scorso novembre, Summers si è dimesso dal consiglio dopo che è stato reso pubblico che aveva cercato consiglio da Jeffrey Epstein via email mentre seguiva un giovane protetto.) OpenAI ha infine ingaggiato il rinomato studio legale WilmerHale per gestire questa revisione. Lo studio ha precedentemente guidato indagini interne su Enron e WorldCom.

Sei individui vicini al processo di indagine hanno indicato che la revisione sembrava progettata per limitare la trasparenza. Alcuni hanno detto che gli investigatori inizialmente non hanno contattato alcuni individui chiave all'interno dell'azienda. Un dipendente è addirittura arrivato a contattare Summers e Bret Taylor per esprimere le proprie preoccupazioni. "Erano interessati solo a quel breve periodo in cui è avvenuto il dramma del consiglio, non ai problemi di integrità di lungo termine di Sam," ha ricordato il dipendente durante il suo colloquio con gli investigatori. Alcuni erano anche riluttanti a condividere le proprie preoccupazioni su Altman a causa di una percepita mancanza di protezione dell'anonimato. "Tutti i segnali indicano che stanno cercando una conclusione predeterminata—per esonerarlo," ha detto il dipendente. (Tuttavia, alcuni avvocati coinvolti nel processo hanno difeso la revisione, definendola "indipendente, approfondita, completa e guidata dai fatti.") Taylor ha anche dichiarato che la revisione era "approfondita e indipendente.")

Il ruolo di un'indagine interna aziendale spesso serve a legittimare una decisione. Nelle aziende private, i risultati delle indagini a volte non si traducono nemmeno in un rapporto scritto, fungendo da modo per mitigare la responsabilità legale. Tuttavia, nei casi che coinvolgono controversie pubbliche, c'è di solito un'aspettativa di un grado più elevato di trasparenza. Nel 2017, prima dell'uscita di Travis Kalanick da Uber, il consiglio di amministrazione aveva assunto un'agenzia esterna e aveva pubblicato un riassunto di 13 pagine dell'indagine al pubblico. Considerando lo status di non profit 501(c)(3) di OpenAI e la natura altamente pubblica di questo licenziamento, molti dirigenti all'interno dell'azienda avevano inizialmente previsto un rapporto di indagine dettagliato. Tuttavia, entro marzo 2024, OpenAI ha annunciato solo il "via libera" di Altman senza rilasciare rapporti formali, riconoscendo un "crollo della fiducia" in circa 800 parole sul loro sito web.

Anche i colleghi ex stanno sentendo le scosse di assestamento. Mira Murati ha lasciato OpenAI nel 2024 per avviare la propria startup di intelligenza artificiale. Successivamente, il stretto alleato di Altman, Josh Kushner, l'ha chiamata. Ha iniziato lodando la sua leadership, ma poi ha fatto una minaccia velata, esprimendo la sua "preoccupazione" riguardo alla sua "reputazione" e menzionando che alcuni ex colleghi ora la vedono come un "nemico." (Kushner, attraverso un portavoce, ha detto che questo racconto "non forniva il contesto completo"; Altman, d'altra parte, ha affermato di non essere a conoscenza della chiamata.)

All'inizio del suo mandato come CEO, Altman annunciò che OpenAI avrebbe creato un'azienda "a profitto limitato" detenuta dall'entità no profit. Questa struttura aziendale contorta e quasi distorta era apparentemente frutto dell'ideazione di Altman stesso. Durante la transizione, un direttore di nome Holden Karnofsky espresse opposizione, ritenendo che questo accordo svalutasse gravemente il valore della no profit. "Non posso in buona coscienza aderire a questo," disse Karnofsky. Secondo i documenti dell'epoca, espresse un voto di dissenso. Tuttavia, dopo che l'avvocato del consiglio suggerì che la sua opposizione "potrebbe servire come un campanello d'allarme per ulteriori indagini sulla legalità della nuova struttura," il suo voto fu infine registrato come astensione e apparentemente senza il suo consenso — potenzialmente costituendo anche una falsificazione di registri commerciali. (OpenAI ci ha detto che più dipendenti ricordano Karnofsky che si è astenuto e hanno fornito verbali delle riunioni come prova.)

Nell'ottobre dello scorso anno, OpenAI ha subito una "ristrutturazione del capitale," diventando un'entità a scopo di lucro. L'azienda ha dichiarato pubblicamente che la sua no profit affiliata — ora chiamata OpenAI Foundation — sarebbe diventata una delle istituzioni più ricche della storia. Tuttavia, la fondazione ora detiene solo il 26% delle azioni dell'azienda, e tutti i suoi direttori tranne uno servono anche nel consiglio di amministrazione a scopo di lucro.

Durante un'udienza congressuale, ad Altman è stato chiesto se avesse "guadagnato molti soldi." Ha risposto: "Non ho alcuna proprietà in OpenAI... Lo faccio perché lo amo." Data la sua partecipazione indiretta attraverso fondi legati a Y Combinator, questa risposta è stata piuttosto cauta. Tecnicamente, è vero. Ma diverse persone, incluso Altman, ci hanno indicato che questa situazione è destinata a cambiare presto. "Gli investitori diranno: 'Devo sapere che quando le cose si fanno difficili, continuerai a farlo,'" ha detto Altman, anche se ha aggiunto che attualmente non ci sono "discussioni attive" al riguardo. Secondo una testimonianza legale, la partecipazione di Greg Brockman vale circa 20 miliardi di dollari, e la quota di Altman dovrebbe teoricamente essere più alta. Tuttavia, Altman ci ha detto che la ricchezza non è il suo principale motivatore. Un ex dipendente lo ha ricordato dire: "Non mi interessa il denaro. Mi interessa di più il potere."

Nel 2023, Altman e Oliver Mulherin hanno tenuto un piccolo matrimonio presso la loro residenza alle Hawaii. (I due si erano incontrati nove anni prima a casa di Peter Thiel vicino alla vasca idromassaggio di notte.) Avevano ospitato molti ospiti in quella proprietà, e le scene descritte dai visitatori che abbiamo intervistato non superavano l'ambito comune dello stile di vita dei super-ricchi: cena preparata da uno chef privato, gite in barca al tramonto. C'era una festa di Capodanno a tema del reality show Survivor; le foto mostravano un gruppo di uomini sorridenti e senza maglietta, incluso il conduttore dello show, Jeff Probst. Altman aveva anche ospitato piccoli raduni nelle sue altre proprietà, con almeno un evento che coinvolgeva un vivace poker a strisce. (Una foto trapelata non includeva Altman, quindi non si sa chi abbia vinto alla fine, ma almeno tre uomini sembravano aver chiaramente perso.) Molti degli ex ospiti intervistati hanno menzionato solo una cosa: era davvero un ospite generoso.

Coloro che erano coinvolti nell'indagine hanno detto che non è mai stato emesso alcun rapporto perché non c'è mai stato un rapporto scritto formale. I cosiddetti risultati dell'indagine sono stati solo brevemente comunicati oralmente a Summers e Taylor. "La revisione non ha concluso che 'Sam è onesto come George Washington che abbatte il ciliegio,'" ha detto una fonte vicina all'indagine. Ma nel complesso, sembrava che l'indagine non si fosse realmente concentrata sul 'problema di integrità' dietro il licenziamento di Altman, con una parte significativa degli sforzi spesa invece per determinare se ci fossero chiari reati; secondo quel criterio, l'indagine ha infine concluso che poteva continuare come CEO. Poco dopo, Altman ha riacquistato il seggio nel consiglio che aveva perso a seguito del suo licenziamento. Fonti interne hanno rivelato che parte del motivo per cui non sono stati memorializzati i risultati dell'indagine per iscritto era anche dovuto ai consigli dei rispettivi avvocati privati di Summers e Taylor. (Summers ha rifiutato di commentare pubblicamente su questa questione; Taylor ha dichiarato che poiché c'era stata una presentazione orale, "non c'era bisogno di un rapporto scritto formale.")

Molti attuali e ex dipendenti di OpenAI ci hanno detto di essere rimasti scioccati dalla mancanza di divulgazione pubblica. Altman ha dichiarato di credere che tutti i membri del consiglio che si sono uniti dopo il suo reintegro fossero stati informati oralmente su queste questioni. "Questa è una menzogna assoluta," ha detto una persona a conoscenza della situazione. Alcuni direttori ci hanno anche detto che le domande in corso sull'integrità di questi "risultati dell'indagine" potrebbero persino rendere necessaria una "ripetizione dell'indagine" in futuro.

Senza documenti scritti, queste accuse sono più facili da minimizzare. Nel frattempo, l'ascesa continua di Altman nello status della Silicon Valley ha ulteriormente indebolito il controllo esterno su queste questioni. Diversi investitori di spicco che avevano lavorato con lui ci hanno parlato di un'abitudine ampiamente nota di Altman: se un investitore scommetteva su un concorrente di OpenAI, lui poteva successivamente "metterlo sulla lista nera". "Se investono in un progetto che a Sam non piace, non aspettatevi di far parte di altre opportunità in seguito," ha detto uno di loro. Un'altra fonte del potere di Altman era la sua vasta rete di investimenti, che a volte si estendeva persino nella sua vita personale. Aveva relazioni finanziarie con diversi ex partner: alcune riguardavano la co-gestione di fondi, altre in cui guidava investimenti, e alcune erano frequenti co-investimenti. Questa pratica non è rara nella Silicon Valley. Molti dirigenti eterosessuali operano anche in questo modo. ("Devi farlo," ci ha detto un noto CEO.) Lo stesso Altman ha dichiarato: "Chiaramente, ho investito con alcuni ex dopo la nostra separazione, e penso che sia assolutamente normale." Tuttavia, questo accordo stesso crea un livello di dipendenza molto elevato. "Questo crea fondamentalmente una dipendenza molto, molto forte," ha detto una persona vicina ad Altman, "molte volte, anche una dipendenza per tutta la vita."

Tuttavia, vari rumor riguardanti la vita personale di Sam Altman sono stati sfruttati e persino distorti dai concorrenti. La feroce competizione commerciale non è una novità, ma la competizione all'interno dell'industria dell'intelligenza artificiale è diventata eccezionalmente brutale. "Shakespeariana," descritta da un dirigente di OpenAI, che ha aggiunto: "Le solite regole del gioco sembrano non applicarsi più." Alcuni intermediari direttamente associati a Elon Musk, ricevendo anche il suo finanziamento in alcuni casi, hanno diffuso dozzine di pagine di "ricerca di opposizione" su Altman. Questi materiali mostrano un alto livello di sorveglianza: comprese società di comodo a lui collegate, informazioni di contatto intime e persino registrazioni di interviste con un presunto lavoratore del sesso in un bar gay. Un intermediario ha anche affermato che gli itinerari di volo di Altman e le feste a cui partecipava erano sotto controllo. Altman ci ha detto: "Sento che nessuno è stato assunto per indagare su di me più di quanto lo sia stato io."

Nel frattempo, varie accuse estreme si stanno anche diffondendo. La personalità dei media di destra Tucker Carlson ha insinuato senza alcuna prova che Altman fosse coinvolto nella morte di un informatore, un'affermazione che i concorrenti hanno continuamente amplificato. La sorella di Altman, Annie, ha dichiarato in una causa e durante un'intervista con noi che lui l'aveva abusata sessualmente da quando aveva tre anni e lui dodici. (Non siamo stati in grado di verificare le affermazioni di Annie.) Altman nega questo, e sua madre e suo fratello hanno anche dichiarato che queste accuse sono "completamente false" e hanno portato "enorme dolore" all'intera famiglia. In un'intervista condotta dalla giornalista Karen Hao per il suo libro "Empire of AI," Annie ha dichiarato che questi ricordi sono stati recuperati in "flashback" nell'età adulta.)

Inoltre, diversi individui di aziende concorrenti e società di investimento ci hanno anche accennato che Altman fosse coinvolto in attività sessuali con minorenni—un'affermazione ampiamente diffusa nella Silicon Valley che sembra altrettanto infondata. Abbiamo trascorso mesi a indagare, conducendo dozzine di interviste, e non abbiamo trovato prove a sostegno di questa affermazione. Altman ha risposto: "Questa è una tattica disgustosa che credo sia dei concorrenti che cercano di 'avvelenare il pool della giuria' per futuri casi." Anche se sembra assurdo, voglio comunque affermare: qualsiasi affermazione su di me riguardante relazioni sessuali con minorenni, assunzione di lavoratori del sesso o coinvolgimento in omicidi è completamente falsa." Ha anche aggiunto che è "in qualche modo grato" per noi che abbiamo trascorso "così tanti mesi a indagare su queste cose in così grande profondità."

Sam Altman ammette di aver avuto relazioni con giovani uomini maggiorenni. Abbiamo intervistato alcuni dei suoi partner, che hanno tutti affermato di non vedere alcun problema in questo. Tuttavia, la "ricerca di opposizione" del campo di Elon Musk ha deliberatamente inquadrato questo come un punto di attacco. (Questi materiali includevano anche alcune affermazioni sensazionali e non verificate, come il cosiddetto "Twink Army" e il "kink del Sugar Daddy.") Altman ha risposto: "C'è molta omofobia amplificata mescolata qui." La giornalista tecnologica Kara Swisher è d'accordo: "Tutti questi ricchi hanno fatto ogni sorta di cose scandalose, più scandalose di qualsiasi cosa abbia sentito su Sam." Ma poiché è un uomo gay a San Francisco, questo viene usato come un'arma."

Negli ultimi dieci anni, i dirigenti delle aziende di social media hanno promesso di poter "cambiare il mondo" con quasi nessun effetto collaterale, liquidando le richieste normative come "Luddisti", suscitando infine l'ira bipartisan. Al contrario, l'immagine di Altman appariva particolarmente "auto-consapevole." Non solo non si è tirato indietro dalla regolamentazione, ma ha anche attivamente chiesto di essa. Nel 2023, testimoniano davanti alla Commissione Giudiziaria del Senato degli Stati Uniti, ha proposto di istituire una nuova agenzia federale per regolare i modelli di intelligenza artificiale avanzata. "Se questa tecnologia va male, le conseguenze saranno molto gravi," ha detto. Il senatore della Louisiana John Kennedy, noto per le sue osservazioni taglienti nei confronti dei CEO delle aziende tecnologiche, sembrava persino in qualche modo approvare, suggerendo a metà scherzo che Altman dovrebbe essere lui a occuparsi della regolamentazione.

Tuttavia, mentre abbracciava pubblicamente la regolamentazione, Altman stava anche facendo pressioni privatamente contro di essa. Secondo Time, tra il 2022 e il 2023, OpenAI è riuscita a indebolire con successo una proposta di regolamento dell'Unione Europea mirata alle grandi aziende di intelligenza artificiale. Nel 2024, il legislatore della California ha introdotto un disegno di legge che richiede test di sicurezza sui modelli di intelligenza artificiale, molti dei quali rispecchiavano da vicino l'advocacy di Altman in Congresso. OpenAI si è opposta pubblicamente al disegno di legge e ha esercitato pressioni dietro le quinte. "Nel corso di quell'anno, abbiamo visto il comportamento di OpenAI diventare sempre più astuto e ingannevole," ci ha detto un assistente legislativo.

Nel frattempo, Musk ha continuato i suoi attacchi pubblici contro Altman, riferendosi a lui come "Scam Altman" e "Swindly Sam." (Quando Altman si è lamentato di un problema con una Tesla su X, Musk ha risposto: "Hai rubato a un'organizzazione senza scopo di lucro.") Ma a Washington, Altman sembrava avere il sopravvento. Musk aveva una volta contribuito con oltre 250 milioni di dollari per aiutare Donald Trump a essere rieletto, servendo brevemente alla Casa Bianca prima di andarsene, rovinando il suo rapporto con Trump.

Oggi, Altman è diventato uno dei tycoon tecnologici preferiti da Trump, visitando anche il Castello di Windsor nel Regno Unito con lui. I due si parlano diverse volte all'anno. "Puoi semplicemente chiamarlo direttamente," ha detto Altman. "Non è quel tipo di amicizia, ma se ho bisogno di parlargli di qualcosa, lo chiamerò." Quando Trump ha ospitato i leader tecnologici alla Casa Bianca l'anno scorso, Musk era assente, e Altman sedeva di fronte al presidente. "Sam, sei un grande personaggio," gli ha detto Trump. "Mi hai detto alcune cose incredibili prima."

L'investitore Ron Conway ha anche fatto pressioni su figure politiche tra cui Nancy Pelosi e Gavin Newsom per spingere per il rifiuto del suddetto progetto di legge. Alla fine, mentre il progetto di legge ha ricevuto supporto bipartisan e è passato, è stato posto il veto da Newsom. Quest'anno, alcuni candidati congressuali a favore della regolamentazione dell'IA hanno affrontato avversari finanziati da "Leading the Future," un super PAC pro-IA. OpenAI ha dichiarato ufficialmente che non avrebbe donato a tali organizzazioni, ma il suo co-fondatore Greg Brockman ha promesso 50 milioni di dollari. (Quello stesso anno, lui e sua moglie hanno anche donato 25 milioni di dollari a un super PAC a sostegno di Trump.)

Le azioni di OpenAI vanno oltre il tradizionale lobbying. L'anno scorso, quando il Senato della California ha proposto una versione rivista di un progetto di legge, Nathan Calvin, un avvocato di un'organizzazione di interesse pubblico coinvolto nella redazione del progetto di legge, ha ricevuto un subpoena da OpenAI durante una cena a casa. L'azienda ha affermato che era per indagare se Musk stesse finanziando segretamente i critici, ma ha richiesto tutte le comunicazioni private di Calvin riguardanti il progetto di legge. "Avrebbero potuto semplicemente chiederci direttamente se avessimo ricevuto soldi da Musk—non li abbiamo ricevuti affatto," ha detto. Altri sostenitori del progetto di legge, così come coloro che criticano la transizione alla commercializzazione di OpenAI, hanno ricevuto anche simili subpoena. "Stanno cercando di intimidire queste persone affinché restino in silenzio," ha dichiarato Don Howard, capo dell'organizzazione per il pubblico interesse. (OpenAI ha dichiarato che questo fa parte delle normali procedure legali.)

In termini di posizione politica, Altman ha a lungo sostenuto il Partito Democratico. Ha affermato: "Sono molto cauto nei confronti di quei governanti autoritari che usano una narrazione di paura per sopprimere i deboli—questo deriva più dal mio background ebraico che dalla mia orientazione sessuale." Nel 2016, ha sostenuto Hillary Clinton, definendo Trump "una minaccia senza precedenti per l'America"; nel 2020, ha donato al Partito Democratico e al fondo della campagna di Biden. Durante il mandato di Joe Biden, ha visitato la Casa Bianca più volte per discussioni politiche e ha contribuito a spingere per il primo quadro normativo sulla sicurezza dell'IA a livello federale.