Суперечка в OpenAI: Влада, довіра та неконтрольовані межі AGI

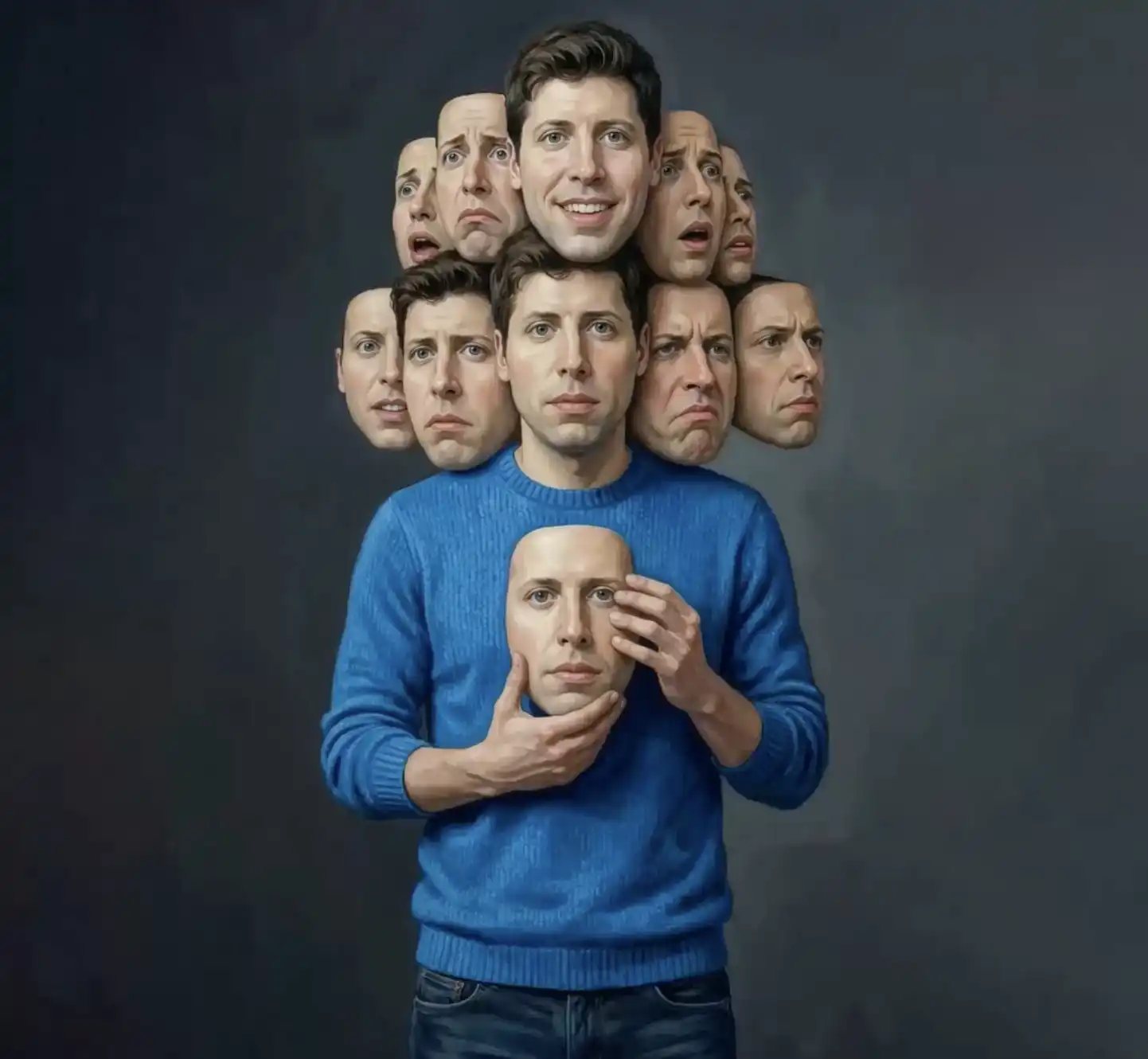

Оригінальний заголовок статті: Сем Альтман може контролювати наше майбутнє, але чи можна йому довіряти?

Автори оригінальної статті: Ронан Ферроу та Ендрю Марантц, Нью-Йоркер

Переклад: Пеггі, BlockBeats

Примітка редактора: У цій статті за допомогою великої кількості неопублікованих документів та поглиблених інтерв'ю знову розглядається внутрішня криза в OpenAI щодо влади та довіри Сема Альтмана. Від усунення з правління до швидкого повторного призначення в "реверсі, подібному до перевороту", ці потрясіння були не одноразовою подією, а зосередженим виверженням давніх конфліктів управління.

В основі конфлікту - безперервна боротьба між двома логіками: з одного боку, неприбуткова місія OpenAI, заснована на "безпеці людини понад усе", а з іншого боку, поступовий перехід до шляху розвитку, орієнтованого на продукти, масштаб і дохід, оскільки AGI наближається, а комерціалізація прискорюється. У цьому процесі зобов'язання щодо безпеки постійно слабшали, а влада та прийняття рішень поступово централізувалися серед небагатьох.

Багато ключових фігур, включаючи Іллю Суцькевера та Даріо Амодея, ставили під сумнів Альтмана, зосереджуючись на непрозорості інформації та стратегічному вираженні, вважаючи, що його стиль керівництва недостатній для ефективного управління технологією, яка «змінить долю людства»; його прихильники, однак, підкреслюють, що його здатність до інтеграції ресурсів, операцій з капіталом та виконання є ключовою для швидкого розширення OpenAI.

Коли технологічна сила достатня для впливу на глобальний порядок, чи достатньо існуючої структури корпоративного управління для обмеження окремих осіб? Іншими словами, в епоху штучного інтелекту справжня невизначеність може виходити не лише з самої технології, але й від тих, хто контролює технологію.

Нижче наведено оригінальну статтю:

Влада та довіра: Прогалини в управлінні за лідерства Олтмана

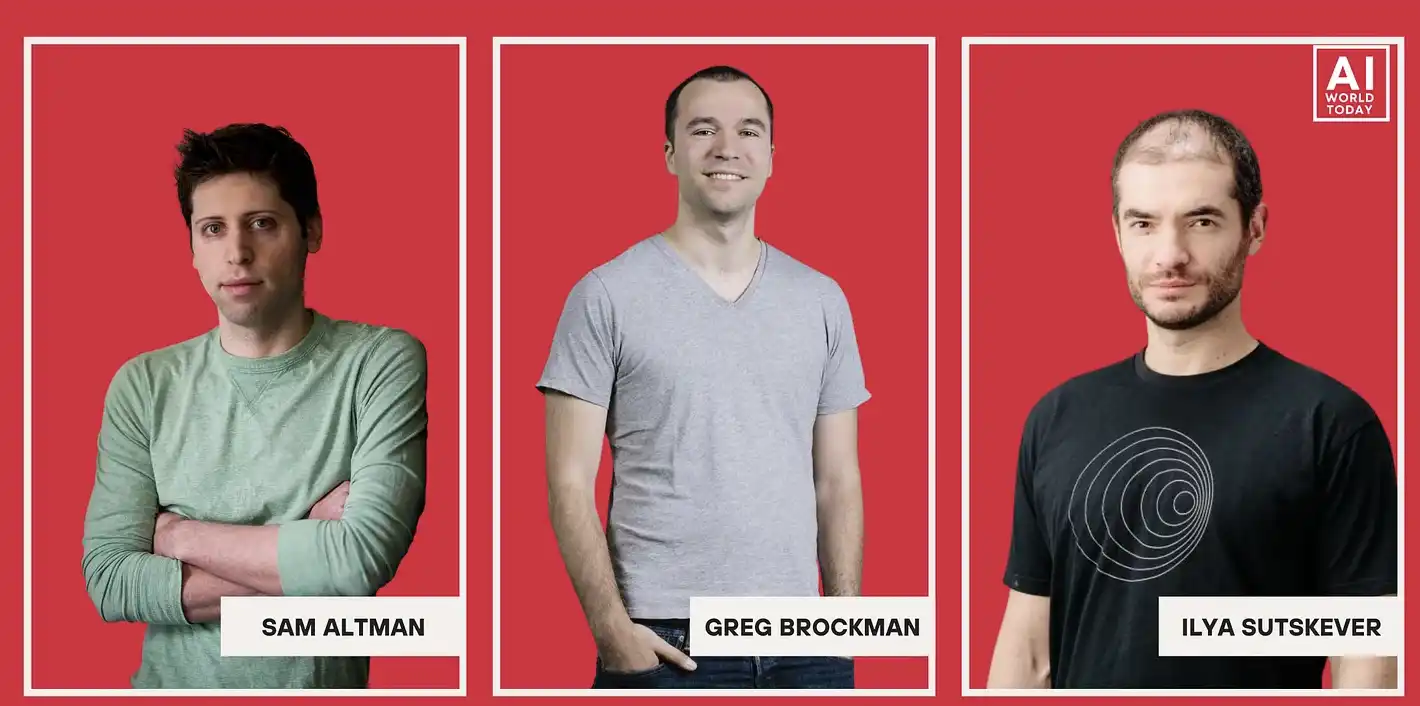

Восени 2023 року головний науковий співробітник OpenAI Ілля Суцкевер надіслав секретну записку трьом іншим членам правління компанії. Протягом попередніх тижнів вони в приватному порядку обговорювали делікатне питання: чи підходять генеральний директор компанії Сем Олтман і його заступник Грег Брокоман для продовження керівництва компанією.

Джерело зображення: AI WORLD TODAY

Суцкевер колись вважав їх обох друзями. У 2019 році він навіть провів весілля Брокомна в офісі OpenAI, де навіть була роборука, яка виконувала роль "носця кілець".

Але коли він став дедалі більше переконуватися, що компанія наближається до своєї довгострокової мети — створення штучного інтелекту, який міг би відповідати або перевершувати людські когнітивні можливості — його сумніви щодо Альтмана поглиблювалися. Як він сказав іншому члену ради в той час: "Я не думаю, що Сем — це та людина, яка повинна тримати палець на кнопці".

На прохання інших членів ради Суцкевер разом із однодумцями склав документ обсягом близько сімдесяти сторінок, що включав журнали чатів у Slack, кадрові файли та супровідні коментарі. Частина вмісту була навіть скріншотами, зробленими телефоном, мабуть, щоб уникнути моніторингу пристроями компанії. Зрештою, він надіслав ці меморандуми іншим членам правління в режимі "прочитай і знищ", щоб переконатися, що їх не побачать інші люди.

"Він тоді дуже злякався", - згадує один із директорів, який отримав матеріали. Ми переглянули ці меморандуми, які раніше ніколи не розкривалися повністю. У документах йшлося про те, що Альтман спотворював факти для виконавчих директорів і членів правління, а також про його обманливу поведінку щодо внутрішніх протоколів безпеки. Одна з довідкових записок про Олтмана починалася зі списку пунктів під заголовком «Сем постійно демонструє…», перший пункт якого був «Брехня».

Багато технологічних компаній стверджують, що «роблять світ кращим», але їхня фактична діяльність обертається навколо максимізації доходів. Однак засновницьким принципом OpenAI мало бути відмінне від цієї моделі. Його засновники, включаючи Олтмана, Суцькевера, Брокомана та Ілона Маска, вважали, що штучний інтелект може бути одним із найпотужніших і потенційно небезпечних винаходів в історії людства. На тлі цього «екзистенційного ризику» компанії може знадобитися нетрадиційна організаційна структура.

OpenAI спочатку була створена як некомерційна організація, і її рада директорів мала завдання поставити «безпеку всього людства» вище за успіх компанії, навіть надавши їй пріоритет над власним виживанням компанії. Генеральний директор повинен володіти надзвичайним характером і етикою.

Як сказав Суцкевер: «Кожен, хто бере участь у створенні цієї технології, яка може змінити цивілізацію, як ми її знаємо, несе величезну відповідальність і безпрецедентний обов'язок». Але він також зазначив, що «ті, хто опиняється на цих посадах, часто є певним типом людей — людей, які прагнуть влади, політичних типів або тих, хто просто насолоджується владою заради неї самої». В одному з меморандумів він висловив занепокоєння з приводу довіри цієї технології комусь, «хто лише говорить те, що хочуть чути інші».

Якщо генеральний директор OpenAI зрештою виявиться ненадійним, то ця рада директорів у складі шести осіб має право звільнити його. Деякі директори, включаючи експерта з політики в галузі штучного інтелекту Хелен Тонер та підприємницю Ташу Макколлей, стали ще більше переконані у своїх попередніх судженнях після прочитання цих мемо: те, що Альтман вважав своєю відповідальністю щодо майбутнього людства, але якому самому не можна довіряти.

Переворот у раді директорів: Сейма Альтмана звільнено

У той час Сем Альтман перебував у Лас-Вегасі, спостерігаючи за перегонами Формули-1, коли Ілля Суцькевер запросив його на відеоконференцію з радою директорів і зачитав коротку заяву про те, що він більше не є працівником OpenAI. Рада, керуючись юридичними консультаціями, опублікувала заяву, в якій йшлося, що Альтмана звільнили за «порушення принципу чесності в комунікації».

Це рішення шокувало багатьох інвесторів і керівників OpenAI. Корпорація Microsoft, яка вклала в OpenAI близько 13 мільярдів доларів, також дізналася про цю новину в останню хвилину, перед тим як рішення було виконане. «Я був неймовірно здивований у той час», — згадував пізніше генеральний директор Microsoft Сатья Наделла. «Я не міг отримати жодної інформації від будь-кого». Потім він зв'язався з Рейдом Хоффманом (співзасновник LinkedIn, інвестор OpenAI і директор Microsoft), який почав розпитувати всюди, чи вчинив Олтман якісь явні проступки. «Я був тоді повністю спантеличений», — розповів нам Хоффман. «Ми шукали такі проблеми, як розкрадання або домагання, але я нічого не знайшов».

Інші бізнес-партнери були також здивовані. Коли Олтман подзвонив інвестору Рону Конвею, щоб повідомити йому про своє звільнення, Конвей обідав з членкинею Конгресу США Ненсі Пелосі, і він передав їй телефон на місці. «Вам краще швидко звідси піти», – сказала вона Конвей.

Тим часом OpenAI був близький до завершення великого раунду фінансування від венчурної компанії Thrive Capital, заснованої Джошем Кушнером, також братом Джареда Кушнера, якого Альтман знав багато років. Ця угода оцінила б OpenAI в 86 мільярдів доларів і дозволила б багатьом працівникам отримати мільйони доларів у вигляді акцій. Кушнер щойно закінчив зустріч з музичним продюсером Ріком Рубіном, коли побачив пропущений виклик від Альтмана і зателефонував йому. «Ми негайно перейшли в бойовий режим», – згадував він пізніше.

У день свого звільнення Олтмен повернувся до свого особняка в Сан-Франциско вартістю 27 мільйонів доларів, звідки відкривається вид на усю затоку, з виступаючим басейном без країв, де він створив тимчасовий командний центр, який він назвав «своєрідним урядом у вигнанні». Конвей, співзасновник Airbnb Брайан Ческі та відомий фахівець з кризового піару Кріс Лехан приєднувалися до нього через відеозв'язок і телефон, іноді розмовляючи годинами без перерви. Деякі члени виконавчої команди Олтмена навіть ночували в коридорах будинку. Юристи розташувалися в його домашньому офісі поруч зі спальнею. Під час безсоння Олтмен ходив туди-сюди в піжамі. Описуючи свій досвід після звільнення в недавньому інтерв'ю, він назвав його "дивним родом фуги".

Оскільки рада мовчала, команда радників Олтмана почала будувати наратив для його повернення. Лехан наполягав, що звільнення було насправді "переворотом", організованим "ефективними альтруїстами", прихильниками системи думок, що наголошує на максимізації загального добробуту людства, які вважали штучний інтелект екзистенційною загрозою. (Гоффман також тоді припустив Наделла, що звільнення могло бути пов'язане з "якимось ефективним альтруїстичним безумством"). Лехан, чиє широко розповсюджене гасло запозичене у Майка Тайсона: "У кожного є план, поки його не вдарють по обличчю", запропонував Олтману розпочати сміливу соціальну медіа-офензиву. Ческі підтримував зв'язок з технічним журналістом Кара Свішер, постійно повторюючи критику ради зовнішньому світу.

Щовечора о шостій годині Олтмен виходив зі своєї «військової кімнати», щоб випити Негроні. Він згадував, що говорив оточуючим: «Ви повинні розслабитися; те, що має статися, станеться». Однак, додав він, журнали викликів показали, що він розмовляв по телефону понад дванадцять годин на день протягом того часу.

У якийсь момент, як повідомило джерело, Олтмен сказав Мірі Мураті, яка на той час виконувала обов'язки тимчасового генерального директора OpenAI, що його союзники «докладають всіх зусиль» і намагаються «відкопати бруд», щоб заплямувати її та інших, хто брав участь у його усуненні. (Сам Олтмен стверджує, що не пам'ятає цієї розмови.)

Через кілька годин після його звільнення Thrive Capital призупинила заплановані інвестиції і дала зрозуміти, що угода буде укладена і співробітники отримають свою частку прибутку лише в тому випадку, якщо Сем Альтман повернеться. Записи текстових повідомлень того часу показали, що Альтман часто спілкувався з Сатья Наделла. (Під час підготовки спільної заяви Альтман запропонував сформулювати її так: "Зараз моїм і Сатья головним пріоритетом є порятунок OpenAI", тоді як Наделла запропонував іншу формулювання: "Забезпечити продовження процвітання OpenAI.")

Зміна влади: Олтмана швидко відновили через 5 днів

Невдовзі після цього Microsoft оголосила, що запустить конкурентний проект для Олтмана та будь-яких працівників OpenAI, які пішли. Одночасно в компанії почали поширювати відкритий лист із проханням повернути Олтмана. Деякі з тих, хто спочатку вагався підписати, отримали благальні дзвінки та повідомлення від колег. Зрештою, більшість працівників OpenAI пригрозили колективною відставкою на підтримку Олтмана.

Правління було загнане в кут. "Контроль Z, це варіант", - сказала Хелен Тонер, маючи на увазі скасування рішення про звільнення. "Інший варіант - повний колапс". Навіть тоді тимчасова генеральна директорка Міра Мураті в підсумку підписала публічний лист. Союзники Альтмана почали намагатися переконати Іллю Суцькевера змінити свою позицію. Дружина Брокмана, Анна, навіть підійшла до нього в офіс і сказала: «Ти хороша людина, ти можеш виправити ситуацію». Суцькевер пізніше пояснив у судовому свідченні: «Я тоді відчував, що якщо ми підемо шляхом, на якому Сем не повернеться, OpenAI буде знищено».

Однієї ночі Олтман прийняв снодійне Амбієн і його розбудив його чоловік, австралійський програміст Олівер Малхерін, який сказав йому, що позиція Суцькевера коливається, і запропонував Олтману негайно зв'язатися з радою. «Я прокинувся в своєрідному тумані, викликаному Амбієном, — згадує Олтман, — і я був повністю дезорієнтований і думав: «Немає жодних шансів, що я зможу зараз поговорити з радою»».

У серії все більш напружених дзвінків Сем Олтман зажадав відставки членів ради, які вимагали його звільнення. Розмірковуючи про ідею повернення, він згадав свою початкову реакцію: «Я збираюся наводити лад у їхньому безладі в цьому неймовірно підозрілому середовищі?» «Я подумав, нізащо», — сказав він. Зрештою Ілля Суцькевер, Хелен Тонер і Таша Макколлей втратили свої місця в раді, залишивши лише Адама Д'Анджело (співзасновника Quora) як оригінального члена ради.

В рамках умов відставки ці члени ради вимагали розслідування звинувачень проти Альтмана, включаючи створення розбіжностей серед керівників і приховування фінансових зв'язків. Вони також наполягали на створенні нової ради для незалежного нагляду за зовнішнім розслідуванням. Однак два нових призначених директора — колишній президент Гарвардського університету Лоуренс Саммерс і колишній технічний директор Facebook Бретт Тейлор — були обрані після тісного спілкування з Альтманом. «Ви думаєте, це спрацює», — написав Альтман у повідомленні Сатья Наделла, «з Бретом, Ларрі Саммерсом і Адамом у раді директорів, мною як генеральним директором і Бретом, який очолює розслідування?» (Макколлі пізніше засвідчив, що коли Тейлора розглядали для включення до ради директорів, вона була стурбована тим, що він може бути занадто поблажливим до Альтмана.)

Менш ніж через п'ять днів після звільнення Альтмана відновили. Співробітники компанії пізніше називали цей період «Бліпом», посилаючись на сюжетний момент з фільму Marvel — коротке зникнення, за яким слідує повернення, але світ був докорінно змінений їхньою відсутністю.

Однак суперечки навколо довіри до Альтмана давно вийшли за межі залу засідань OpenAI. Колега, яка організувала його відсторонення, звинуватила його в поширеній оманливій поведінці, яка була б неприйнятною для будь-якого корпоративного керівника, не кажучи вже про лідера, який володіє такою трансформаційною технологією. "Нам потрібні перевірки влади, які відповідають цій владі", - сказала нам Міра Мураті. "Рада попросила про відгук, і я просто чесно поділилася тим, що бачила, і я за цим стою". Прихильники Олтмана, з іншого боку, давно применшували ці звинувачення. Після звільнення інвестор Рон Конвей надіслав повідомлення Брайану Ческі та Крісу Лехане, закликаючи до контрнаступу у сфері зв'язків з громадськістю: "Це стосується репутації Сема". Він також розповів The Washington Post, що до Альтмана несправедливо ставиться «некерована рада директорів».

Відтоді OpenAI стала однією з найдорожчих компаній у світі, і, за повідомленнями, готується до потенційного IPO на трильйон доларів. Тим часом Альтман займається розбудовою масштабної інфраструктури штучного інтелекту, причому деякі зусилля поширюються на авторитарні режими за кордоном. OpenAI також прагне до великих державних контрактів і поступово встановлює стандарти для застосування ШІ у виконанні імміграційних законів, внутрішньому спостереженні та автономній зброї в зонах конфліктів.

Сем Альтман керував зростанням OpenAI, постійно малюючи грандіозне бачення майбутнього. У своєму блозі 2024 року він написав: «Захоплюючі перемоги — вирішення проблеми зміни клімату, створення колоній за межами Землі, розкриття всіх фізичних законів — все це з часом стане буденним». Цей наратив лежить в основі одного з найшвидше зростаючих стартапів в історії, який значною мірою залежить від фінансування високозабезпечених партнерів. Економіка США дедалі більше залежить від кількох компаній зі штучним інтелектом з високим рівнем залученості, і багато експертів, включаючи самого Альтмана, іноді попереджають про ризик утворення бульбашки в галузі. «Хтось втратить багато грошей», — сказав він журналістам минулого року. Якщо бульбашка лопне, це може спровокувати економічну катастрофу; але якщо його найсміливіші прогнози збудуться, він також може стати однією з найбагатших і найвпливовіших осіб у світі.

Під час напруженої розмови після звільнення Олтмана рада вимагала, щоб він визнав наявність зразка введення в оману. За словами присутніх джерел, він неодноразово говорив: «Це абсурдно» і стверджував: «Я не можу змінити те, ким я є». Пізніше Олтман стверджував, що не пам'ятає цієї розмови. «Я думаю, що, можливо, те, що я намагався сказати, було більше схоже на: «Я завжди намагався бути об'єднувачем»», - пояснив він нам пізніше, пояснюючи свій успіх у керівництві неймовірно успішною компанією цією рисою. Він пояснив ці критику тенденцією на початку своєї кар'єри «занадто уникати конфліктів». Член правління, однак, запропонував кардинально іншу інтерпретацію: "Те, що він насправді мав на увазі, це те, що — 'У мене є така річ, коли я буду брехати людям, і я не зупинюся.'"

Відхід від місії: Від безпеки на першому місці до бізнесу на першому місці

І так, виникло більш фундаментальне питання: Чи колеги, які виступали за його відставку, діяли через надмірний ентузіазм і особисту неприязнь, чи їхній вирок був обґрунтованим, а Альтман дійсно недостовірним?

Одного зимового ранку цього року ми зустрілися з Альтманом у штаб-квартирі OpenAI в Сан-Франциско, це була одна з більш ніж десятка розмов, які ми провели для цієї статті. Компанія нещодавно переїхала в дві одинадцятиповерхові скляні вежі, в одній з яких раніше розміщувався інший технологічний гігант, Uber. Співзасновник і колишній генеральний директор Uber Тревіс Каланік вважався неперевершеним генієм-підприємцем, поки його не витіснили в 2017 році, також через етичні проблеми. (Зараз Каланік очолює стартап у галузі робототехніки; він сказав, що у вільний час використовує ChatGPT від OpenAI, щоб «досліджувати межі квантової фізики».)

Співробітник провів нам екскурсію офісними приміщеннями. У зоні, наповненій довгими загальними столами та природним світлом, була динамічна цифрова картина комп'ютерного вченого Алана Тюрінга, чиї очі стежили за нами, коли ми рухалися. Інсталяція була явно відсиланням до «тесту Тюрінга» — мисленнєвого експерименту 1950 року, який мав визначити, чи може машина переконливо імітувати людину. (У дослідженні 2025 року продуктивність ChatGPT у цьому тесті фактично перевершила продуктивність реальних людей.) Зазвичай картина була інтерактивною. Але наш гід пояснив, що її голосову функцію було відключено, оскільки вона постійно «підслуховувала» розмови працівників і часто втручалася. В інших частинах офісу були видимі вивіски з написом «Відчуйте AGI» — слоган, який спочатку придумав Ілля Суцкевер, щоб нагадати колегам про ризики, пов'язані з передовими штучними загальними інтелектами (точка, в якій машини досягають рівня пізнавальних здібностей людини). Після Бліпа це перетворилося на веселий слоган, що святкує процвітаюче майбутнє.

У неприміщеній конференц-залі на восьмому поверсі ми знайшли Сема Альтмана. «Я чув, як люди говорили про втому від прийняття рішень, і я ніколи не розумів цього», — сказав він. «Зараз я щодня ношу сірий светр і джинси, і навіть вибираючи, який сірий светр з шафи, я думаю: «Я б не хотів приймати це рішення».

Олтман виглядав вічно молодим, з худорлявою статурою, широко розставленими блакитними очима, трохи пошарпаним волоссям, але йому було сорок. Він і Олівер Малхерін мають однорічного сина, народженого сурогатною матір'ю. «Я думаю, бути президентом Сполучених Штатів, безумовно, більше тиску, але з усіх робочих місць, які я міг би реально виконувати, це те, яке я міг би уявити як найбільш напружене», — сказав він, дивлячись на одного з нас, потім на іншого. «Я так описував це друзям: «Це найцікавіша робота в світі до того дня, коли ми запустили ChatGPT». До цього ми робили ці гігантські наукові прориви — я думав, що це одне з найважливіших наукових відкриттів за десятиліття». Він опустив погляд. «Але з моменту запуску ChatGPT усі рішення стали дуже важкими».

Олтман виріс у Клейтоні, Міссурі, замовному передмісті Сент-Луїса, як старший з чотирьох дітей. Його мати, Конні Гібстайн, є дерматологом, а батько, Джеррі Альтман, був агентом з нерухомості, який також працював над ініціативами у сфері житла. Він виріс у храмі реформатської єврейської громади, відвідував приватну підготовчу школу, а пізніше описав її як «не просте місце для того, щоб бути геєм». Однак, загалом, середовище верхнього середнього класу, в якому він перебував, було відносно ліберальним.

Приблизно у віці шістнадцяти чи сімнадцяти років він зазнав серйозного фізичного нападу та гомофобних образ під час нічного перебування в гей-районі Сент-Луїса. Альтман не повідомив про інцидент і не захотів надавати більше подробиць, заявивши, що більш повний звіт «зробить мене схожим на того, хто маніпулює людьми або шукає співчуття». Він применшив цей досвід і важливість своєї сексуальної орієнтації для своєї ідентичності. Але він також визнав: «Ймовірно, тут є щось дуже глибоке з психологічної точки зору, відчуття, що я вийшов, але насправді не вийшов, щоб уникнути більших конфліктів».

Його брат описав його дитячу особистість так: «Я повинен перемагати, і я повинен контролювати все», в інтерв'ю The New Yorker у 2016 році. Пізніше Альтман навчався в Стенфордському університеті і часто брав участь у покерних іграх за межами кампуса. «Я відчуваю, що дізнався там більше про життя та бізнес, ніж у коледжі».

Ера Y Combinator: Суперечка про перебільшення та довіру

Студенти Стенфорда амбітні, але найбільш активні з них часто вирішують кинути навчання. В кінці другого курсу Олтмен поїхав до Массачусетсу, щоб приєднатися до першої групи підприємців у програмі стартап-інкубатора Y Combinator. Цю установу співзаснував відомий інженер-програміст Пол Грем. Кожен учасник приєднався до стартапу з ідеєю. (Серед його групи були команди, які пізніше заснували Reddit і Twitch.) Проект Олтмана пізніше отримав назву Loopt, ранній продукт соціальної мережі, який дозволяв друзям бачити місцезнаходження один одного, відстежуючи місцезнаходження їх перевернутих телефонів. Компанія продемонструвала як його виконавські здібності, так і його схильність займатися сірими зонами. На той час федеральні регулятори вимагали від операторів мобільного зв'язку можливості визначати місцезнаходження телефону в надзвичайних ситуаціях, і Олтман уклав угоди з операторами мобільного зв'язку, щоб включити цю можливість у свій продукт.

Більшість працівників під час ери Loopt любили Сема Альтмана, але деяких вразила його схильність до "перебільшення" навіть у деяких незначних питаннях. Деякі згадували, що Альтман хвалився тим, що є чемпіоном з пінг-понгу "на зразок чемпіона з пінг-понгу середньої школи Міссурі", хоча насправді був одним із найгірших гравців у компанії. (Альтман сказав, що це, ймовірно, була просто жарт.) Старший працівник Loopt, Марк Джейкобстайн, був призначений інвесторами, щоб виконувати обов'язки "опікуна" Альтмана, і пізніше він прокоментував у біографії Кіча Хейгея "Оптиміст": "Існує сіра зона між "я думаю, що я можу це зробити" і "я це зробив", і в своїй найекстремальнішій формі ця невизначеність може призвести до результатів, подібних до Theranos".

За словами Хейгея, через занепокоєння щодо стилю керівництва Олтмана та відсутності прозорості, деякі старші співробітники Loopt двічі пропонували раді звільнити його з посади генерального директора. Однак, водночас, він також мав сильний особистий вплив. Колишній співробітник пригадав, що член ради безпосередньо відповів: "Це компанія Сема, повертайся і роби свою роботу". (Однак деякі члени ради також заперечували, що ці спроби звільнення були серйозними.)

У Loopt ніколи не було покращення зростання користувачів, і зрештою її придбала фінансово-технологічна компанія у 2012 році. За словами інсайдерів, ця покупка була здебільшого для того, щоб допомогти Олтману "вийти з положення з гідністю". Однак у 2014 році, коли Пол Грем пішов із Y Combinator, він все ще обрав Альтмана своїм наступником. "Я запитав його на власній кухні", - розповів Грем Нью-Йоркер", "Він усміхнувся, ніби все стало на свої місця. Я ніколи не бачив нестримної усмішки Сема, такої, яку ти показуєш, коли кидаєш паперовий м'яч далеко в сміттєвий кошик".

Нова посада зробила тоді 28-річного Альтмана "королівським фаворитом". Його завданням було відбирати найамбітніших, найперспективніших підприємців, з'єднувати їх з провідними програмістами та інвесторами, а також допомагати їм створювати монопольні компанії, що лідирують у своїй галузі (тим часом Y.C. отримувала від 6% до 7% акцій).

Під його керівництвом Y Combinator стрімко розширився, кількість інкубованих проектів зросла з десятків до сотень. Але деякі інвестори Кремнієвої долини почали вірити, що його інтереси не були повністю узгоджені. Інвестор розповів нам, що Арлтман "вибірково особисто інвестував у найякісніші компанії, щоб виключити зовнішніх інвесторів" (Арлтман заперечував цю заяву). Він також виступав скаутом для Sequoia Capital, беручи участь у інвестиціях у проекти на ранній стадії та отримуючи певний прибуток.

За словами джерел, коли Арлтман інвестував у фінансово-технологічну компанію Stripe як ангел-інвестор, він наполягав на отриманні більшої частки акцій, що викликало невдоволення Sequoia внутрішньо. Джерело прокоментувало, що це відображає стратегію "Спочатку Сам". (Олтман заперечував цю заяву. Він інвестував близько 15 000 доларів у Stripe приблизно в 2010 році, володіючи близько 2% акцій, і зараз компанія оцінюється більш ніж у 150 мільярдів доларів.) Олтман стверджував, що інвестував приблизно в 400 компаній.

До 2018 року кілька партнерів Y Combinator були незадоволені поведінкою Олтмана і повідомили про це Грехем. Згодом Грем провів відверту розмову зі своєю дружиною та співзасновницею Y.C. Джесікою Лівінгстон і Альтманом. Після цього Грем почав публічно заявляти, що хоча Альтман усно погодився піти, він фактично не пішов.

Альтман повідомив деяким партнерам, що він піде з посади президента, але залишиться головою. У травні 2019 року Y Combinator опублікував у блозі повідомлення про нового президента з приміткою: "Сем переходить на посаду голови YC". Через кілька місяців цю заяву переглянули на "Сем Альтман відійшов від будь-якої оперативної ролі в YC", а потім цей речення повністю видалили. Проте станом на 2021 рік, Олтман все ще значився головою Y Combinator у США Повідомлення Комісії з цінних паперів та бірж. (Олтман сказав, що дізнався про це пізніше.)

Сем Альтман неодноразово заявляв публічно протягом багатьох років і під час недавніх юридичних свідчень, що його не звільнили з Y Combinator, і сказав нам, що він не чинив опору від'їзду. Пол Грем написав у Твіттері: «Ми не хотіли, щоб він пішов, але хотіли, щоб він вибрав між YC і OpenAI». У своїй заяві Грем також сказав нам: «У нас немає законних повноважень звільняти когось; все, що ми можемо зробити, це чинити моральний тиск».

Однак у приватному порядку ця історія була більш відвертою — відхід Алтмана був пов'язаний з відсутністю довіри з боку партнерів YC. Цей опис перебування Алтмана в Y Combinator базується на інтерв'ю з кількома засновниками та партнерами YC і сучасних матеріалах, всі з яких свідчать про те, що розставання було не зовсім взаємним. Повідомляється, що Грем навіть сказав колегам YC в одній з внутрішніх дискусій, що «Сем весь час брехав нам, перш ніж його звільнили».

Відхилення від місії OpenAI: Від безпеки на першому місці до прибутку на першому місці

У травні 2015 року Олтман надіслав електронного листа Ілону Маску, який тоді був приблизно 100-м найбагатшим людиною у світі. Як і багато підприємців із Силіконової долини, Маск тоді був сильно зосереджений на низці того, що він вважав "екзистенційними ризиками" - хоча більшість інших вважали їх віддаленими можливостями. "Ми повинні бути дуже обережними з ШІ", - написав він у Твіттері, "Можливо, це небезпечніше, ніж ядерна зброя".

Олтман, який довгий час був оптимістом у сфері технологій, швидко змінив свій тон щодо ШІ на більш апокаліптичний. У публічних виступах та приватних комунікаціях з Маском та іншими він застерігав від того, щоб дозволити монополізувати цю технологію технологічним гігантам, які керуються прибутком. "Мені було цікаво, чи є спосіб зупинити гонку озброєнь штучного інтелекту", - написав він, "але якщо немає ніякого способу, то, здається, найкраще, щоб це зробила відповідна компанія". Використовуючи ядерну аналогію, він запропонував створити "Штучний інтелект" Мангеттенський проект. Далі він окреслив основні принципи цієї організації: «Безпека повинна бути головним пріоритетом»; «Звичайно, ми повинні дотримуватися всіх правил і підтримувати їх».

Згодом він і Маск зупинилися на назві проекту: OpenAI.

На відміну від Мангеттенського проекту, який спочатку очолювався урядом і завершився створенням атомної бомби, OpenAI на ранніх етапах фінансувався приватними особами. Олтмен передбачав, що як тільки з'явиться форма "суперінтелекту", що перевершує загальний штучний інтелект (AGI), він генеруватиме достатньо економічної цінності, щоб "захопити майбутній світловий конус всесвіту". Однак він також неодноразово наголошував на його потенційних екзистенційних ризиках: у якийсь момент вплив технології на національну безпеку може бути настільки значним, що це може змусити уряд США взяти під контроль OpenAI, навіть націоналізувати його та перенести його об'єкти на безпечну базу в пустелі. До кінця 2015 року Маск переконався. "Ми повинні оголосити про фінансування в розмірі 1 мільярда доларів", - написав він, - "і я підтримаю це, якщо інші не будуть".

Сем Альтман спочатку розмістив OpenAI у неприбутковій організації Y Combinator і представив його як внутрішній благодійний проект. Він виділив акції YC членам, які приєдналися до OpenAI, і перерахував кошти пожертвувань через рахунки YC. У якийсь момент ця лабораторія навіть покладалася на підтримку фонду YC, у якому Альтман мав особисті інтереси. (Пізніше Альтман назвав цю частку капіталу "незначною" і заявив, що акції YC, виділені працівникам, були з його особистих активів.)

Аналогія з "Мангеттенським проектом" також проявилася в гонці за талантами. Подібно до досліджень ядерного поділу, машинне навчання тоді було науковою галуззю невеликого масштабу з епохальним потенційним впливом, якою керувала невелика група виразно талановитих людей. Ілон Маск, Альтман і Грег Брокомен, який приєднався з Stripe, всі вірили, що справді проривні вчені-комп'ютерники були рідкістю. Google, з іншого боку, мав величезну перевагу з точки зору фінансування та часу. «Ми значно відстаємо в плані людських ресурсів і фінансів, розрив просто неймовірний», — пізніше написав Маск у листі. Але він також вірив, що «якщо нам вдасться продовжувати залучати найкращих фахівців і забезпечувати правильний напрямок, OpenAI все одно переможе».

Однією з найважливіших цілей набору був Ілля Суцкевер — інтровертований, інтенсивний дослідник, якого часто вважають одним з найобдарованіших вчених в галузі штучного інтелекту свого часу. Народившись у Радянському Союзі в 1986 році, Суцкевер мав відступаючу лінію волосся, глибокі очі та звичку замислюватися перед тим, як говорити. Іншою ключовою фігурою був Даріо Амодей, енергійний дослідник з біофізичним досвідом, який часто нервово розчісував свої чорні волосся в моменти напруги і відповідав на електронні листи з кількох речень багатопараграфовими есе. Обидва на той час працювали на високооплачуваних посадах в інших компаніях, але Олтмен доклав значних зусиль, щоб переманити їх до себе. Пізніше він пожартував: "Я практично 'переслідував' Іллю".

Хоча Маск може мати більшу популярність, Олтмен є більш витонченим у своїх діях. Він ініціював спілкування з Амодеї електронною поштою та організував особисту зустріч в індійському ресторані. (Олтмен: "Мій Uber потрапив в аварію! Можливо, запізнюся на 10 хвилин". Амодей: "О ні, сподіваюся, ти в порядку". Як і багато дослідників штучного інтелекту, Амодей вважає, що ця технологія повинна бути розроблена лише після того, як буде доведено, що вона "відповідає" людським цінностям, тобто не катастрофічно відхиляється від намірів людини, наприклад, не знищує людство в ім'я "очищення навколишнього середовища". Олтман неодноразово піднімав цю проблему безпеки під час розмови, вселяючи впевненість.

Амодей, який пізніше приєднався до компанії, провів роки, документуючи дії Олтмана та Брокомана, зібравши їх у документ під назвою «Мій досвід в OpenAI» (підзаголовок: «Цілком таємно: Не розповсюджувати»). Понад двісті сторінок файлів, пов'язаних з Амодеєм, включаючи ці нотатки, внутрішні електронні листи та меморандуми, циркулювали в колах Силіконової долини, але ніколи не оприлюднювалися. У цих записах Амодей написав, що мета Олтмана полягала в тому, щоб створити «лабораторію штучного інтелекту, орієнтовану на безпеку («можливо, спочатку ні, але незабаром»).

У грудні 2015 року, за кілька годин до офіційного оголошення OpenAI, Олтман написав електронного листа Маску, згадуючи чутку: Google «завтра зробить величезну зворотну пропозицію всім у OpenAI, намагаючись повністю знищити організацію». Маск запитав: «Чи дав Ілля остаточну відповідь?» Олтман відповів, що Суцкевер був непохитний. Дійсно, Google запропонував Суцкеверу річну зарплату в розмірі 6 мільйонів доларів, яку OpenAI не могла зрівняти. Проте Олтман залишився впевненим, заявивши: «Шкода, що вони не на стороні тих, хто робить правильні речі».

Ілон Маск колись надав офісний простір для OpenAI в старій фабриці валіз у районі Мішн Сан-Франциско. Як розповів нам Ілля Суцкевер, основний заклик для працівників у той час був: «Ви всі збираєтеся врятувати світ». Якби все пішло добре, засновники OpenAI вірили, що штучний інтелект принесе утопію «після дефіциту»: автоматизуючи важку працю, вилікуючи рак, надаючи людям більше вільного часу та достатку. Але якщо технологія вийшла з-під контролю або потрапила до чужих рук, руйнування могло бути тотальним, наприклад, її можна було б використати для розробки нових біологічних видів зброї або передових дронів; моделі могли б перевершити людський контроль, самовідтворюватися на таємних серверах, недоступних для відключення; у крайніх випадках вони могли б навіть взяти під контроль енергосистему, фондовий ринок або ядерний арсенал.

Хоча не всі погоджуються з цими оцінками, Сем Альтман неодноразово висловлював свою віру в цей ризик. У 2015 році в блозі він написав, що машинний інтелект на надлюдському рівні «не повинен бути злим, щоб знищити людство, він може просто бути байдужим, оскільки він досягає інших цілей... випадково знищуючи нас». Співзасновник OpenAI пообіцяв не віддавати перевагу швидкості перед безпекою, а статут компанії включає юридичне зобов'язання «приносити користь усьому людству». Вони також побоюються, що якщо ШІ стане найпотужнішою технологією, будь-який окремий контролер отримає безпрецедентну владу — сценарій, який вони називають «диктатурою AGI».

Після відходу Маска такі дослідники, як Даріо Амодей, почали висловлювати невдоволення стилем управління Грега Брокомнана, деякі вважають його авторитарним, тоді як Суцькевер описують як «принципового, але без організаційних здібностей». Під час свого переходу на посаду генерального директора, Альтман, здається, дав різні обіцянки різним фракціям у компанії. Він запевнив деяких дослідників, що ослабить авторитет Брокмана, але водночас досяг "усної угоди" з Брокманом і Суцкевером: він буде генеральним директором, але піде у відставку, якщо того попросять обидва. (Альтман заперечує цю заяву, стверджуючи, що його запросили бути генеральним директором. Троє визнають існування угоди, причому Брокман каже, що вона була неофіційною: "Він в односторонньому порядку сказав, що якщо ми з ним попросимо, він піде у відставку. Ми фактично виступали проти цієї ідеї, але він сказав, що це важливо для нього і що він зробив це з альтруїзму.) Пізніше рада дізналася, що генеральний директор фактично створив для себе «тіньову раду», що стало шоком.

Внутрішні записи свідчать про те, що команда засновників мала сумніви щодо неприбуткової структури ще в 2017 році. Того ж року, після того, як Маск спробував захопити контроль, Брокомман написав у щоденнику: «Не можу сказати, що ми дійсно дотримувалися принципу неприбутковості... Якщо ми станемо корпорацією B через три місяці, то попередні заяви були брехнею». Амодей також зафіксував у ранніх записах, що він запитав Брокоммана про його головні пріоритети, на що той відповів: «гроші та влада». (Брокомман заперечує цю заяву.) Його щоденник також розкриває суперечливий світогляд: з одного боку, він заявляє: "якщо інші не багаті, мені не важливо бути багатим", а з іншого боку, запитує себе: "що я дійсно хочу?" і однією з відповідей є "досягти фінансового статку в 1 мільярд доларів".

У 2017 році Суцкевер прочитав наукову роботу дослідників Google в офісі, в якій пропонувалася "нова проста мережева архітектура — Transformer". Він вистрибнув зі стільця, побіг у коридор і вигукнув: "Припиніть все, що ви робите, це відповідь". Для нього ця архітектура дозволила б OpenAI навчати складніші моделі. Цей прорив привів до появи перших генеративних попередньо навчених моделей Transformer і став основою для ChatGPT пізніше.

Олтмен раніше пообіцяв першим співробітникам, що OpenAI завжди залишатиметься неприбутковою організацією, що змусило багатьох програмістів погодитися на значне зниження зарплат, щоб приєднатися до компанії. OpenAI також отримала близько 30 мільйонів доларів пожертвувань, у тому числі від організації Open Philanthropy, ключового фінансового центру руху за ефективний альтруїзм, який давно підтримує проекти, такі як розповсюдження москітних сіток у злиденних районах.

Щоденну роботу в основному контролювали Брокман і Суцкевер, тоді як Маск і Олтмен залишалися зайнятими своїми іншими підприємствами, зазвичай відвідуючи компанію раз на тиждень. До вересня 2017 року Маск почав втрачати терпіння. Коли почалися обговорення про можливий перехід OpenAI в комерційну компанію, він зажадав більшості контролю.

Відповіді Олтмана змінювалися в різних ситуаціях, але він завжди наполягав на тому, що якщо компанія буде реструктурована під керівництвом генерального директора, то цією посадою повинен бути він. Суцкевер був особливо стурбований цим. Від імені себе та Брокмана він надіслав довгий електронний лист Маску та Олтману з назвою "Чесні думки", в якому зазначив: "Метою OpenAI є покращення майбутнього та уникнення диктатури AGI". Звертаючись до Маска, він написав: "Тому створення структури, яка могла б зробити вас диктатором, є поганою ідеєю". Він також висловив подібні занепокоєння Олтману, заявивши: "Ми не можемо зрозуміти, чому посада генерального директора є для вас такою важливою. Ваші причини постійно змінюються, що ускладнює нам розуміння справжньої мотивації».

«Джентльмени, я закінчив», — відповів Маск, — «Або займайтеся чимось іншим самостійно, або продовжуйте підтримувати неприбутковий статус OpenAI, інакше я просто безкоштовно фінансую вас для запуску стартап-компанії». Через п'ять місяців він пішов, висловлюючи видиме невдоволення. (У 2023 році він заснував конкурента xAI, що працює на прибуток. Наступного року він подав позов проти Олтмана та OpenAI за шахрайство та порушення благодійної довіри, стверджуючи, що його «обережно маніпулювали» і що Олтман вдався до «довгої афери», використовуючи його занепокоєння щодо ризиків, пов'язаних з ІІ, щоб отримати фінансування. Судовий процес триває, а OpenAI рішуче спростовує ці звинувачення.)

З розвитком технологічних можливостей ми дізналися, що близько десятка провідних інженерів OpenAI провели серію таємних зустрічей, на яких обговорювали, чи можна довіряти команді засновників, включаючи Сема Альтмана та Грега Брокомана. Під час однієї з цих зустрічей один з працівників згадав сатиричний ескіз британського комедійного дуету Мітчелл і Вебб — солдат нацистської армії на Східному фронті раптом переживає прозріння і запитує: «Невже ми лиходії?»

До 2018 року Даріо Амодей почав публічно ставити під сумнів мотиви засновників. Пізніше він написав у записці: "Все виглядає як безкінечна схема фінансування. Я відчуваю, що OpenAI дійсно потребує чіткого визначення: що він хоче робити, чого не хоче робити і як його існування зробить світ кращим". Незважаючи на те, що у компанії вже є заява про місію — "забезпечити, щоб штучний загальний інтелект приносив користь усьому людству" — Амодей вважав, що ця заява не була зрозумілою для виконавчої команди.

На початку 2018 року він почав складати статут компанії і, після тижнів обговорень з Олтманом і Брокомманом, наполягав на включенні одного з найрадикальніших положень: якщо "проект, орієнтований на цінності та безпеку", буде ближчим до досягнення AGI, ніж OpenAI, компанія "припинить конкуренцію і замість цього допоможе цьому проекту". Це називалося положенням "об'єднання та допомога" — наприклад, якщо Google першим досягне безпечного AGI, OpenAI теоретично розпуститься і передасть ресурси Google. З точки зору традиційного бізнесу така відданість була майже немислимою, але OpenAI ніколи не мав наміру стати традиційною компанією.

Ця передумова зіткнулася з реальністю навесні 2019 року. На той час OpenAI вели переговори з Microsoft про потенційні інвестиції в розмірі до 1 мільярда доларів. Хоча Амодей (який тоді очолював команду з питань безпеки) брав участь у презентації проекту Біллу Гейтсу, у команді все ще існували побоювання, що Microsoft може ввести умови, які послаблять етичні зобов'язання OpenAI. Амодей надав Олтману пріоритетний список вимог до безпеки, на першому місці в якому було положення про «об'єднання та допомогу».

Олтмен погодився на той час. Однак, коли угода наближалася до завершення в червні, Амодей виявив нову умову в угоді, яка давала Microsoft право накласти вето на злиття OpenAI. "Це становило 80% порушення статуту", - згадував він пізніше. Він запитав Олтмена про це, і спочатку Олтмен заперечував існування такої умови. Амодей прочитав текст контракту дослівно на місці, і врешті-решт довелося ще одному колезі безпосередньо зв'язатися з Олтменом. (Олтман заявив, що не пам'ятає цього інциденту.)

Безпека Exodus і народження антропоцентризму

У записах Амодея також зафіксовано низку загострення напружених конфліктів. На зустрічі через кілька місяців Олтман викликав його та його сестру Даніелу, яка також працювала над питаннями безпеки та політики в компанії, стверджуючи, що отримав достовірну інформацію від «старшого керівника», що двоє з них планують «переворот». У записах зазначено, що Даніела «емоційно розгубилася» на місці та викликала керівника, який потім заперечував, що коли-небудь говорив щось подібне. Знайомі з ситуацією джерела нагадали, що пізніше Альтман заперечував, що коли-небудь висував це звинувачення: "Я ніколи цього не казав". Даніела відповіла: "Ви щойно це зробили". (Альтман заявив, що його спогади дещо відрізняються, стверджуючи, що він звинуватив Амодея лише в "політичній поведінці"). У 2020 році Амодей, Даніела та кілька колег покинули компанію, щоб заснувати Anthropic, яка з тих пір стала одним із головних конкурентів OpenAI.

Тим часом Альтман продовжував наголошувати на відданості OpenAI безпеці, особливо в присутності потенційних кандидатів. Наприкінці 2022 року четверо вчених-комп'ютерників опублікували статтю, у якій висунули ризик "хибного вирівнювання": високорозвинені моделі можуть добре працювати під час тестування, але переслідувати свої власні цілі після фактичного розгортання. (Цей на перший погляд науково-фантастичний сценарій вже мав місце за певних експериментальних умов.) Через кілька тижнів після публікації статті один із авторів – аспірант Університету Каліфорнії в Берклі – отримав електронний лист від Олтмана. Олтман висловив занепокоєння з приводу загрози «незбалансованого ШІ» і обмірковував можливість інвестування 1 мільярда доларів для вирішення цієї проблеми, наприклад, шляхом створення глобальної дослідницької премії. Незважаючи на те, що студент чув чутки про те, що «Сем був трохи підступним», обіцянка зрештою переконала його призупинити навчання і приєднатися до OpenAI.

Однак після численних зустрічей навесні 2023 року ставлення Олтмана, здається, змінилося. Він більше не згадував про створення нагороди, а замість цього звернувся до створення внутрішньої "суперзгуртованої команди" в компанії. Офіційна заява стверджувала, що команда отримає "20% захищених обчислювальних ресурсів компанії", ресурс, вартість якого може становити понад 1 мільярд доларів. У заяві також підкреслювалося, що якщо проблему вирівнювання не вдасться вирішити, AGI може призвести до "знесилення людства або навіть його зникнення". Ян Лейк, який очолював команду, пізніше заявив: "Це дійсно була дуже ефективна стратегія утримання".

Однак обіцянка "20% обчислювальних ресурсів" не була виконана. Чотири особи, пов'язані з командою або тісно стежать за нею, заявили, що фактично виділені ресурси становили лише 1–2% від загального обчислювального потенціалу компанії. Крім того, дослідник зазначив, що "більшість так званих обчислень для супервирівнювання фактично виконується на найстарішому кластері з найгіршими показниками продуктивності". Члени команди загалом вважали, що більш просунуте обладнання було пріоритетним для проектів, що приносять дохід. (OpenAI це заперечує.) Лайк порушував це питання з тодішнім технічним директором Мірою Мураті, але відповідь була такою, що немає потреби далі наполягати — ця задача була "нереалістичною" з самого початку.

Приблизно в той час колишній працівник розповів нам, що Ілля Суцькевер «почав наголошувати на важливості безпеки». На початку діяльності OpenAI, коли він вважав катастрофічний ризик обґрунтованим, він все ще був дещо віддаленим; однак, коли він поступово почав вірити, що AGI наближається, ця стурбованість швидко зростала. За словами працівника, під час загальних зборів «Ілля встав і сказав, що в найближчі кілька років настане момент, коли майже всім у компанії доведеться перейти на роботу з безпеки, інакше ми зазнаємо невдачі». Однак наступного року цю «команду з суперузгодження» розформували, перш ніж вона завершила свою місію.

Наразі внутрішні комунікації свідчать про те, що керівники та члени правління починають вірити, що приховування та введення в оману Сема Альтмана можуть мати суттєвий вплив на безпеку продуктів OpenAI. Під час зустрічі в грудні 2022 року Олтман запевнив раду, що всі функції майбутнього GPT-4 були схвалені комітетом з безпеки. Член ради та експерт з політики в галузі штучного інтелекту Хелен Тонер попросила надати відповідні документи, але виявила, що дві найбільш суперечливі функції — одна з яких дозволяє користувачам "настроювати" модель, а інша — розгортати її як персонального асистента — насправді не були схвалені. Після зустрічі інший член ради, підприємець Таша Макколлей, була викликана співробітником, який запитав, чи знає вона про "інцидент з дотриманням вимог у Індії": Олтман ніколи не згадував у численних оновленнях ради, що Microsoft запустила ранню версію ChatGPT в Індії, не завершивши необхідні перевірки безпеки. "Це було майже повністю замовчано", — сказав тодішній дослідник OpenAI Джейкоб Хілтон.

Хоча ці проблеми безпосередньо не призвели до інциденту з безпекою, дослідник Керролл Вейнрайт вважав, що вони відображають «постійний зсув у бік продукту, а не безпеки». Після випуску GPT-4 Ян Лайк, який відповідав за роботу з безпеки, написав у раду: «OpenAI відходить від своєї місії. Ми надаємо пріоритет продукту та доходам, потім можливостям, дослідженням і масштабуванню, а вирівнювання та безпека опиняються на третьому місці». Він також зазначив, що «такі компанії, як Google, витягують уроки — прискорюють розгортання, нехтуючи проблемами безпеки».

У листі до членів ради Макколлі написав: «Я вважаю, що ми дійсно на етапі, коли необхідний посилений нагляд». Однак, коли рада намагалася вирішити цю проблему, вони явно опинилися в невигідному становищі. «Відверто кажучи, це група людей, які не мають реального досвіду», – сказала колишній член ради Сью Юн. У 2023 році компанія готувалася до випуску GPT-4 Turbo. Згідно з описом Суцькевера в меморандумі, Альтман сказав Мірі Мураті, що моделі не потрібен дозвіл на безпеку, і приписав це рішення генеральному раднику компанії Джейсону Квону. Але коли Мураті запитав Квона у Сlack, той відповів: «Е-е... Я не зовсім розумію, чому Сем так думає». (OpenAI заявила, що цей інцидент «не є значущим».)

Невдовзі після цього рада вирішила звільнити Олтмана, але згодом світ став свідком того, як він швидко скасував це рішення. Статут OpenAI все ще доступний на офіційному веб-сайті, але ті, хто знайомий з документами про управління компанією, кажуть, що його зміст був значно ослаблений до майже безглуздого стану. У червні минулого року Олтман написав у особистому блозі про суперінтелект: «Ми перетнули горизонт подій; старт розпочався».

Відповідно до початкового статуту, це мало стати поворотним моментом для компанії, щоб припинити конкуренцію та перейти до співпраці. Однак у статті під назвою «Ніжна сингулярність» він прийняв абсолютно новий тон, замінивши «екзистенційний страх» на «оптимістичну уяву»: «У нас у всіх буде все краще, і ми будемо створювати все кращі речі один для одного». Він визнав, що проблеми з вирівнюванням залишаються невирішеними, але переосмислив їх як «неприємність», подібну до звикання до алгоритму рекомендацій Instagram.

На Альтмана часто дивляться з повагою або скептицизмом як на "наймогутнішого оповідача свого покоління". Стіва Джобса, яким він захоплювався, колись вважали людиною, що володіє "полем спотворення реальності", яка з абсолютною впевненістю формує світ відповідно до свого бачення. Але навіть Джобс ніколи не говорив користувачам: якщо вони не купують його продукт, людство може загинути. У 2008 році, у віці всього лише 23 років, його наставник Пол Грем так описав Альтмана: "Кинь його на острів канібалів, повернися через п'ять років, і він буде королем". Ця оцінка базувалася не на його досягненнях на той час, а на його майже безмежній силі волі.

Однак для деяких із тих, хто працював з ним найтісніше, ця риса має іншу сторону. Оскільки Сатскєвер дедалі більше турбувався про безпеку штучного інтелекту, він склав серію меморандумів про Альтмана та Грега Брокомана — набір документів, настільки значущих у Силіконовій долині, що їх навіть називають "Меморандумами Іллі".

Тим часом Даріо Амодейі продовжував документувати. Ці матеріали не надавали так званих "доказів вини", але зображували серію, здавалося б, розрізнених, але все ж накопичувальних моделей поведінки: таких як пропозиція однієї й тієї ж посади різним людям, надання суперечливих даних про публічну інформацію та невизначеність щодо процесів безпеки. Висновок Суцкевера полягав у тому, що ця поведінка «не створює середовища, сприятливого для безпечного AGI»; Амодей був більш прямолінійним, написавши: «Проблема з OpenAI — це сам Сем».

Ми провели інтерв'ю з більш ніж сотнею людей, знайомих з підходом Олтмана: нинішні та колишні співробітники та директори OpenAI, його колеги та конкуренти, друзі та вороги — у Силіконовій долині багато хто часто виконує кілька ролей. Деякі захищали його ділову хватку, вважаючи, що Суцкевер і Амодей були просто невдалими конкурентами; інші бачили в ньому наївного, неуважного вченого, або навіть екстреміста, що потрапив у пастку «апокаліптизму». Йон вважав, що Олтман не був «макіавеллівським лиходієм», а людиною, переконаною в своїй власній наративі, «він настільки занурений у свою віру в себе, що приймає рішення, які незрозумілі в реальному світі — але він і не живе в реальному світі».

Однак думка більшості опитаних схожа на думку Суцкевера та Амодея: У Альтмана надзвичайна сила волі, що виділяє його навіть серед промислових титанів, чиї імена викарбувані на ракетах. "Він не пов'язаний "реальністю", - сказав член правління, - "Він володіє двома рисами, які рідко зустрічаються разом: одне - це сильне бажання бути коханим, догоджати іншій стороні в кожному взаємодії; інше - майже антисоціальне, безтурботне щодо наслідків обману інших".

Більше одного респондента спонтанно вживали термін "антисоціальна особистість". Альтман, одноліток першої групи Y Combinator, був колегою програміста Аарона Шварца, який пізніше покінчив життя самогубством у 2013 році. Перед своєю смертю Шварц висловив своєму другові занепокоєння щодо Альтмана: «Ви повинні розуміти, що Семові ніколи не можна довіряти. Він антисоціальна особистість; він здатний на все». Кілька керівників Microsoft також заявили, що, незважаючи на довготривалу підтримку Альтмана Сатья Наделла, відносини між двома стають напруженими. «Він буде вводити в оману, спотворювати, переглядати або навіть скасовувати угоди», — сказав один з керівників. Раніше цього року OpenAI підтвердила Microsoft як ексклюзивного постачальника хмарних послуг для своєї «безстанової моделі», але в той же день оголосила про партнерство з Amazon на суму 500 мільярдів доларів, зробивши останню ексклюзивним продавцем своєї платформи штучного інтелекту для підприємств. Хоча ця угода не порушувала контракт, Microsoft вважала, що існує потенційний конфлікт. (OpenAI заявила, що не порушуватиме контракт.) Виконавчий директор навіть прокоментував: «Я вважаю, що є значна ймовірність того, що в майбутньому його будуть сприймати як когось подібного до Берні Медоффа або Сема Банкмана-Фріда».

Олтман не є технічним генієм — на думку багатьох колег, його професійні навички програмування або машинного навчання обмежені, і він може навіть плутати базові поняття. Він створив OpenAI в основному шляхом інтеграції коштів та технічних ресурсів інших людей. Це не рідкість, це роль підприємця. Що більш примітно, це його здатність переконувати інженерів, інвесторів і громадськість з протилежними поглядами, переконуючи їх, що його пріоритети також є їхніми. Коли ці люди намагаються зупинити його, він часто може розрядити ситуацію відповідною риторикою, принаймні тимчасово; і до того часу, коли інша сторона усвідомлює проблему, він зазвичай вже досяг своєї мети. "Він буде проектувати деякі структури, щоб обмежити своє майбутнє на папері", - сказав Вейнрайт, "але коли майбутнє дійсно настане і потрібно буде обмежити, він буде демонтувати ці структури по одній".

"Його переконання неймовірно сильне, як маніпуляція розумом джедая", - сказав виконавчий директор технологічної компанії, який працював з ним, "Це зовсім інший рівень". У дослідженнях узгодження з ІІ існує класична концепція: воля людства проти могутнього ІІ, причому останній майже неминуче переважає, як шаховий гросмейстер проти дитини. І з точки зору цього виконавчого директора, спостерігати за тим, як Альтман орієнтувався серед різних сторін під час заходу "Blip", було як дивитися на те, як "АГІ виривається з клітки".

У дні після свого звільнення Сем Альтман намагався запобігти будь-якому розслідуванню заяв проти нього. Він висловив двом людям свою стурбованість тим, що навіть існування розслідування змусить його виглядати винним. (Альтман заперечує цю заяву.) Однак після відставки члени ради наполягали на тому, що «незалежне розслідування має відбутися» як умова його відходу, і Альтман врешті погодився на «перевірку» «недавніх подій». За словами джерел, знайомих з переговорним процесом, двоє нових членів ради наполягали на тому, щоб очолити цю перевірку самостійно.

Лоуренс Саммерс, використовуючи свої зв'язки в політиці та на Уолл-стріт, надавав певну довіру цій перевірці. (У листопаді минулого року Саммерс подав у відставку з ради після того, як стало публічно відомо, що він звертався за порадою до Джеффрі Епштейна електронною поштою, коли займався молодим протеже.) OpenAI в кінцевому підсумку залучила відому юридичну фірму WilmerHale для проведення цієї перевірки. Фірма раніше проводила внутрішні розслідування в Enron і WorldCom.

Шість осіб, близьких до процесу розслідування, зазначили, що перегляд, здається, був спрямований на обмеження прозорості. Деякі сказали, що спочатку слідчі не зверталися до деяких ключових осіб у компанії. Один із працівників навіть зв'язався з Саммерсом і Бретом Тейлором, щоб висловити свої занепокоєння. "Їх цікавив лише той короткий період, коли відбувалася драма в раді, а не давнишні проблеми з чесністю Сема", - згадує співробітник під час свого інтерв'ю слідчим. Деякі також вагалися ділитися своїми занепокоєннями щодо Олтмана через сприйняття відсутності захисту анонімності. "Усі ознаки вказують на те, що вони шукають заздалегідь визначений висновок - виправдати його", - сказав працівник. (Однак деякі адвокати, залучені до процесу, захищали перегляд, назвавши його "незалежним, ретельним, всебічним і керуючись фактами". Тейлор також заявив, що перегляд був "ретельним і незалежним".)

Роль внутрішнього корпоративного розслідування часто полягає в легітимізації рішення. У приватних компаніях результати розслідування іноді навіть не призводять до складання письмового звіту, що слугує засобом зменшення юридичної відповідальності. Однак у випадках, що викликають суспільний резонанс, зазвичай очікується вищий рівень прозорості. У 2017 році, перед відходом Тревіса Каланіка з Uber, рада директорів найняла зовнішню фірму та оприлюднила 13-сторінковий звіт про розслідування. Враховуючи статус неприбутковості OpenAI за розділом 501(c)(3) та високий суспільний резонанс цього звільнення, багато керівників компанії спочатку очікували детального звіту про розслідування. Однак станом на березень 2024 року OpenAI лише оголосила про "відсутність претензій" до Альтмана, не оприлюднивши жодних офіційних звітів, визнавши "зруйновану довіру" приблизно в 800 словах на своєму вебсайті.

Наслідки відчувають навіть колишні колеги. Міра Мураті покинула OpenAI у 2024 році, щоб заснувати власний стартап у сфері штучного інтелекту. Згодом її зателефонував її близький союзник Джош Кушнер. Він почав із похвал її лідерству, але потім зробив завуальовану погрозу, висловивши свою "турботу" про її "репутацію" і згадавши, що деякі колишні колеги тепер вважають її "ворогом". (Кушнер через представника сказав, що цей переказ "не надав повного контексту"; з іншого боку, Олтман стверджував, що не знає про дзвінок.)

На початку свого перебування на посаді генерального директора Олтман оголосив, що OpenAI створить компанію з "обмеженим прибутком", яка буде належить неприбутковому об'єднанню. Ця заплутана, майже викривлена структура компанії, мабуть, була придумана самим Альтманом. Під час переходу директор на ім'я Холден Карнофскі висловив свою незгоду, вважаючи, що ця угода серйозно недооцінює вартість некомерційної організації. "Я не можу з чистим сумлінням підтримати це", - сказав Карнофскі. Згідно з записами того часу, він проголосував проти. Однак після того, як юрист ради запропонував, що його опозиція "може стати червоним прапором для подальшого розслідування законності нової структури", його голос був зрештою зареєстрований як утримання і, здається, без його згоди - що потенційно може навіть становити фальсифікацію комерційних записів. (OpenAI повідомила нам, що кілька співробітників пам’ятають, що Карнофскі утримався, і надали хвилини засідання як доказ.)

У жовтні минулого року OpenAI зазнала «капітальної реструктуризації», ставши комерційною організацією. Компанія публічно заявила, що її афілійована некомерційна організація — тепер під назвою OpenAI Foundation — стане однією з найбагатших установ в історії. Однак фонд тепер володіє лише 26% акцій компанії, а всі її директори, крім одного, також працюють у комерційній раді.

Під час слухань у конгресі Альтмана запитали, чи він «заробив багато грошей». Він відповів: «Я не володію жодною часткою в OpenAI... Я роблю це, тому що мені це подобається». Враховуючи його непряму участь через фонди, пов'язані з Y Combinator, ця відповідь була досить обережною. Технічно це вірно. Але кілька осіб, включаючи Олтмана, повідомили нам, що ця ситуація, ймовірно, скоро зміниться. «Інвестори скажуть: «Мені потрібно знати, що коли справи підуть погано, ви все одно будете це робити», — сказав Олтман, хоча він додав, що наразі про це немає «активних обговорень». Згідно з юридичним свідченням, частка Грега Брокомна коштує близько 20 мільярдів доларів, а частка Олтмана теоретично має бути вищою. Проте Олтман розповів нам, що багатство не є його основним мотиватором. Колишній працівник згадав, як він сказав: «Мені байдужі гроші. Мені більше подобається влада».

У 2023 році Олтман і Олівер Малхерін провели невелику весілля у своїй резиденції на Гаваях. (Вони познайомилися дев'ятьма роками раніше в будинку Пітера Тієля біля басейну пізно вночі.) Вони приймали багато гостей у цьому будинку, і сцени, описані відвідувачами, з якими ми брали інтерв'ю, не виходили за межі звичайного способу життя супербагатих: вечеря, приготована приватним шеф-кухарем, прогулянки на човні на заході сонця. Була новорічна вечірка на тему реаліті-шоу Уцілілий; на фотографіях була група безсорочених, усміхнених чоловіків, включаючи ведучого шоу Джеффа Пробста. Олтман також проводив невеликі зібрання в інших своїх будинках, принаймні на одному з заходів був запальний стрип-покер. (На витік фотографії не був присутній Олтман, тому невідомо, хто врешті-решт переміг, але принаймні троє чоловіків явно програли.) Багато з колишніх гостей, яких опитав журналіст, згадували лише одне: він дійсно був щедрим господарем.

Учасники розслідування заявили, що жодного звіту ніколи не було опубліковано, оскільки ніколи не було офіційного письмового звіту. Так звані результати розслідування були лише усно доведені до Саммерса і Тейлора. "Огляд не дійшов висновку, що "Сем такий же чесний, як Джордж Вашингтон, який зрубав вишню"", - сказав джерело, близьке до розслідування. Але загалом здавалося, що розслідування не зосереджувалося на «проблемі цілісності», яка стояла за звільненням Альтмана, і значну частину зусиль було витрачено на те, щоб визначити, чи були чіткі кримінальні правопорушення; за цим стандартом розслідування врешті-решт дійшло висновку, що він може продовжувати працювати генеральним директором. Невдовзі після цього Альтман повернув собі місце в раді, яке він втратив після звільнення. Інсайдери розповіли, що частина причини того, що результати розслідування не були зафіксовані письмово, також була пов'язана з порадами приватних адвокатів Саммерса і Тейлора. (Саммерс відмовився коментувати цю справу публічно; Тейлор заявив, що оскільки був усний брифінг, «не було потреби в офіційному письмовому звіті».)

Багато нинішніх і колишніх співробітників OpenAI розповіли нам, що вони були шоковані відсутністю публічного розголосу. Олтмен заявив, що, на його думку, всі члени правління, які приєдналися після його повернення на посаду, були усні проінформовані про ці питання. "Це відверта брехня", - сказав один із знайомих із ситуацією. Деякі директори також повідомили нам, що поточні питання щодо цілісності цих "результатів розслідування" можуть навіть призвести до необхідності "повторного розслідування" в майбутньому.

Без письмових записів ці звинувачення легше заперечувати. Тим часом подальше зростання статусу Олтмена в Силіконовій долині ще більше послабило зовнішній контроль за цими питаннями. Кілька відомих інвесторів, які працювали з ним, розповіли нам про широко відому звичку Олтмана: якщо інвестор робить ставку на конкурента OpenAI, він може пізніше «поставити його в чорний список». «Якщо вони інвестують у проект, який Саму не подобається, не сподівайтеся, що ви зможете взяти участь в інших можливостях пізніше», – сказав один з них. Іншим джерелом влади Олтмана була його велика інвестиційна мережа, яка іноді навіть виходила за межі його особистого життя. У нього були фінансові відносини з кількома колишніми партнерами: деякі з них були пов'язані з спільним управлінням фондами, інші – з тим, що він керував інвестиціями, а деякі були частими спільними інвестиціями. Ця практика не є рідкістю в Силіконовій долині. Багато гетеросексуальних керівників також діють таким чином. («Ви повинні це робити», – сказав нам відомий генеральний директор.) Сам Альтман заявив: «Очевидно, я інвестував у деяких колишніх після того, як ми розлучилися, і я думаю, що це абсолютно нормально». Але сама ця домовленість створює дуже високий рівень залежності. «Це в принципі створює дуже, дуже сильну залежність, – сказав близький до Альтмана чоловік, – багато разів навіть на все життя».

Проте різні чутки, що стосуються особистого життя Сема Альтмана, були використані і навіть спотворені конкурентами. Жорстка конкуренція в бізнесі — це не новина, але конкуренція в галузі штучного інтелекту стала надзвичайно жорстокою. "Шекспірівська", — описав її виконавчий директор OpenAI, який додав: "Здається, звичайні правила гри більше не діють". Деякі посередники, безпосередньо пов'язані з Ілоном Маском, які в деяких випадках навіть отримували його фінансування, поширювали десятки сторінок "досліджень опозиції" про Альтмана. Ці матеріали свідчать про високий рівень стеження: включно з фіктивними компаніями, пов'язаними з ним, особистою контактною інформацією та навіть записами інтерв'ю з так званим секс-працівником у гей-барі. Один із посередників також стверджував, що відстежувалися маршрути польотів Альтмана та вечірки, на які він відвідував. Олтман сказав нам: «Мені здається, що нікого не наймали, щоб розслідувати мене більше, ніж я сам».

Тим часом поширюються також різні екстремальні звинувачення. Правоцентристський медіаперсонаж Та́кер Карлсон натякнув без жодних доказів, що Олтман був причетний до смерті інформатора, що конкуренти постійно підсилювали. Сестра Олтмана Енні заявила в позові та під час інтерв'ю з нами, що він сексуально зловживав нею, починаючи з того часу, коли їй було три роки, а йому було дванадцять. (Нам не вдалося перевірити заяви Енні. Олтмен заперечує це, і його мати та брат також заявили, що ці звинувачення є «абсолютно неправдивими» і принесли «величезний біль» усій родині. В інтерв'ю, яке провела журналістка Карен Хао для своєї книги «Імперія ШІ», Енні заявила, що ці спогади відновилися у неї у вигляді «спогадів минулого» у дорослому віці.)

Крім того, кілька осіб з конкуруючих компаній та інвестиційних фірм також натякнули нам, що Олтмен брав участь у сексуальних діях з неповнолітніми, що є широко поширеним твердженням у Силіконовій долині, яке здається однаково безпідставним. Ми провели місяці розслідування, провели десятки інтерв'ю і не знайшли жодних доказів, що підтверджують це твердження. Олтмен відповів: «Це огидна тактика, яка, на мою думку, є спробою конкурентів «отруїти джерело присяжних» для майбутніх справ. Хоча це звучить абсурдно, я все одно хочу заявити: будь-які твердження про те, що я маю сексуальні стосунки з неповнолітніми, наймаю секс-працівників або причетний до вбивства, є абсолютно неправдивими". Він також додав, що він "дещо вдячний" за те, що ми витратили "стільки місяців на розслідування цих речей так глибоко".

Сем Альтман визнає, що мав стосунки з молодими чоловіками, які досягли повноліття. Ми провели інтерв'ю з деякими з його партнерів, які всі сказали, що не бачать в цьому проблеми. Однак "дослідження опозиції" з табору Ілона Маска навмисно представили це як атаку. (Ці матеріали навіть містили деякі сенсаційні та неперевірені твердження, такі як так звана "Армія красунчиків" та "Збочення багатія"). Олтман відповів: "Тут багато підсиленої гомофобії". Журналістка з питань технологій Кара Свішер також погоджується: "Усі ці багаті люди робили всілякі обурливі речі, більш обурливі, ніж все, що я чув про Сема. Але оскільки він є геєм у Сан-Франциско, це використовується як зброя".

Протягом останнього десятиліття керівники компаній соціальних мереж колись обіцяли, що вони можуть "змінити світ" майже без побічних ефектів, відхиляючи вимоги регуляторів як "людитів", що врешті-решт викликало гнів з обох сторін. На противагу цьому, образ Алтмана видався особливо «самовсвідомим». Він не лише не уникав регулювання, але й активно закликав до нього. У 2023 році, даючи свідчення перед Юридичним комітетом Сенату США, він запропонував створити нове федеральне агентство для регулювання передових моделей штучного інтелекту. «Якщо ця технологія вийде з-під контролю, наслідки будуть дуже серйозними», – сказав він. Сенатор від Луїзіани Джон Кеннеді, відомий своїми різкими висловлюваннями на адресу генеральних директорів технологічних компаній, навіть видався дещо схвальним, напівжартома припустивши, що Алтман сам повинен очолити регулювання.

Однак, публічно підтримуючи регулювання, Олтман також приватно лобіював проти нього. За даними Time, у період з 2022 по 2023 рік компанія OpenAI успішно зірвала регуляторну пропозицію Європейського Союзу, спрямовану на великі компанії зі штучного інтелекту. У 2024 році законодавчі збори Каліфорнії запропонували законопроект, що вимагає тестування безпеки моделей штучного інтелекту, багато з яких точно відображали адвокацію Олтмана в Конгресі. OpenAI публічно виступив проти законопроекту і чинив тиск за лаштунками. "Протягом цього року ми бачили, як поведінка OpenAI стає все більш хитрою та оманливою", - сказав нам помічник законодавця.

Тим часом Маск продовжував свої публічні нападки на Олтмана, називаючи його «шахраєм Олтманом» і «шахраєм Семом». (Коли Олтман поскаржився на проблему з Теслою в X, Маск відповів: «Ти вкрав у некомерційну організацію»). Але у Вашингтоні Олтман, здається, має перевагу. Маск колись пожертвував понад 250 мільйонів доларів, щоб допомогти Дональду Трампу переобратися, і ненадовго працював у Білому домі, перш ніж пішов, що зіпсувало його стосунки з Трампом.

Сьогодні Олтман став одним із улюблених Трампом технолордів, навіть відвідував з ним Віндзорський замок у Великобританії. Вони розмовляють кілька разів на рік. «Ви можете просто зателефонувати йому безпосередньо», – сказав Олтман. «Це не такий тип дружби, але якщо мені потрібно буде з ним поговорити, я зателефоную». Коли Трамп приймав лідерів технологічних компаній у Білому домі минулого року, Маск був відсутній, а Альтман сидів навпроти президента. «Сейме, ти великий хлопець», – сказав йому Трамп. «Ви розповіли мені деякі неймовірні речі раніше».

Інвестор Рон Конвей також лобіював політичних діячів, включаючи Ненсі Пелосі та Гевіна Ньюсома, щоб вони виступили за відхилення вищезазначеного законопроекту. Зрештою, хоча законопроект отримав підтримку з обох боків і був прийнятий, його наклав вето Ньюсом. Цього року деякі кандидати до Конгресу, які підтримують регулювання штучного інтелекту, зіткнулися з опонентами, яких фінансує "Leading the Future", просуперкомітет, що підтримує штучний інтелект. OpenAI офіційно заявила, що не буде робити пожертвувань таким організаціям, але її співзасновник Грег Брокомман пообіцяв 50 мільйонів доларів. (Того ж року він і його дружина також пожертвували 25 мільйонів доларів просуперкомітету, який підтримує Трампа.)

Дії OpenAI виходять за рамки традиційного лобіювання. Минулого року, коли Сенат Каліфорнії запропонував переглянуту версію законопроекту, Натан Келвін, юрист організації громадських інтересів, який брав участь у розробці законопроекту, отримав повістку від OpenAI під час вечері вдома. Компанія стверджувала, що це необхідно для розслідування того, чи таємно фінансував критику Мск, але запросила всі приватні комунікації Келвіна щодо законопроекту. "Вони могли б просто запитати нас, чи отримали ми гроші від Маска, ми цього не робили", - сказав він. Інші прихильники законопроекту, а також ті, хто критикував перехід OpenAI до комерціалізації, також отримали подібні повістки. "Вони намагаються залякати цих людей до мовчання", - сказав Дон Ховард, голова організації громадських інтересів. (OpenAI заявила, що це частина нормальних юридичних процедур.)

Що стосується політичних поглядів, Олтман давно підтримує Демократичну партію. Він заявив: «Я дуже обережно ставлюся до тих авторитарних правителів, які використовують наратив страху для придушення слабких — це більше від мого єврейського походження, ніж від моєї сексуальної орієнтації». У 2016 році він підтримав Гілларі Клінтон, назвавши Трампа «безпрецедентною загрозою для Америки»; у 2020 році він пожертвував Демократичній партії та на виборчий фонд Байдена. Під час перебування Джо Байдена на посаді він кілька разів відвідував Білий дім для обговорення політики та допомагав просувати перші регуляторні рамки безпеки штучного інтелекту на федеральному рівні.

Однак до 2024 року, коли рейтинг схвалення Байдена знизився, позиція Олтмана почала змінюватися: "Незалежно від результатів виборів, Америка буде в порядку". Після перемоги Трампа він пожертвував 1 мільйон доларів у фонд його інавгурації та сфотографувався з інтернет-знаменитостями Джейком і Логаном Полом на церемонії інавгурації. Він написав у Твіттері: "Останнім часом я уважніше стежу за @potus, і це дійсно змінило моє сприйняття його (бажаю, щоб я почав думати незалежно раніше...)." У перший день перебування Трампа на посаді він скасував виконавчі укази Байдена щодо штучного інтелекту. Колишній високопосадовець уряду прокоментував: «Він знайшов ефективний спосіб змусити адміністрацію Трампа працювати на себе».

Протягом багатьох років Олтмен завжди порівнював розвиток AGI з «Мангеттенським проектом». Так само, як Дж. Роберт Оппенгеймер колись мобілізував учених з почуттям місії «проти нацистів», Олтмен також використовує наратив геополітичної конкуренції для здобуття підтримки. Зіткнувшись з різними аудиторіями, він гнучко використовує цю аналогію — іноді наголошуючи на прискоренні, іноді на обережності. Влітку 2017 року під час зустрічі з представниками розвідки США він стверджував, що Китай запустив «Мангеттенський проект AGI» і використовував це для отримання державної фінансової підтримки. Коли його попросили надати докази, він лише сказав: «Я чув деякі речі», але ніколи не надавав конкретних доказів. Державний службовець, який брав участь у розслідуванні, пізніше заявив, що таких проектів не знайдено: «Це більше схоже на рекламний трюк». (Олтман стверджував, що не пам'ятає, щоб він так це формулював.)

Коли він зіткнувся з аудиторією, яка більше орієнтувалася на безпеку, він, у свою чергу, наголосив на важливості міжнародної координації. У 2017 році Амодей найняв адвоката, який займається суспільними інтересами, Пейдж Хедлі, щоб вона виступала радником з питань політики та етики. В одній з внутрішніх презентацій Хедлі запропонувала створити міжнародний координаційний механізм на зразок НАТО, щоб уникнути катастрофічної гонки озброєнь у сфері штучного інтелекту. Однак, за її словами, Брокомман не був стурбований цим: "Що б я не говорила, він завжди повертався до одного питання: як нам отримати більше фінансування? Як нам перемогти?" На основі численних інтерв'ю та записів Брокомман навіть висунув іншу ідею: отримання прибутку від торгів між США, Китаєм і Росією: "Оскільки ера ядерної зброї може працювати таким чином, чому б не штучний інтелект?"

Він був шокований у той час: "Вони навіть не заперечували проти цієї ідеї — 'Ми обговорюємо те, що може бути найруйнівнішою технологією в історії, а що, якщо ми продамо її Владіміру Путіну?'" (Грег Броком, однак, заявив, що ніколи серйозно не розглядав можливість "аукціонування" моделей штучного інтелекту урядам. "Ми просто обговорювали деякі потенційні рамки співпраці з макрорівня, такі як механізм співпраці в галузі штучного інтелекту, подібний до Міжнародної космічної станції", - сказав представник OpenAI. "Зображення цього як щось інше є абсолютно абсурдним.")

Мозкові штурми часто породжують деякі неймовірні ідеї на початку. Пейдж Хедлі спочатку сподівався, що концепція, яку пізніше почали називати внутрішнім "планом країн", буде швидко відкладена. Однак, за словами кількох учасників та відповідних записів того часу, керівництво OpenAI стало все більше захоплюватися цією ідеєю. Тодішній керівник політики Джек Кларк сказав, що мета Брокомана полягала в тому, щоб "створити ситуацію, схожу на дилему в'язня, коли всі країни повинні будуть фінансувати нас", і "в межах цієї структури нефінансування стає небезпечним актом". Молодший дослідник згадував, що коли він почув детальний опис цього плану на зустрічі компанії, він подумав: "Це просто божевілля".

Керівники навіть обговорювали цей план принаймні з одним потенційним спонсором. Однак пізніше того ж місяця, після того, як кілька співробітників висловили намір піти у відставку, план було призупинено. "Сем втрачав членів команди", - сказав Хедлі. "Я відчував, що в його розрахунках це завжди було важливіше, ніж "цей план може спровокувати великий конфлікт влади, тому він за своєю суттю нерозумний".

Незважаючи на провал "плану країн", Сем Альтман не відмовився від варіанту цієї ідеї. У січні 2018 року він скликав "A.G.I. Подія «Вихідний день» в готелі Bel-Air у Лос-Анджелесі. Цей курорт у голлівудському стилі відомий своїм рожевим садом бугенвілеї та басейном зі справжніми лебедями. Серед учасників були філософ з Оксфорда і «пророк» ризиків ШІ Нік Бостром, захисник ШІ ОАЕ Омар Аль Олама та щонайменше семеро мільярдерів. Для тих, хто стурбований питаннями безпеки, ця подія була описана як можливість обговорити «як підготуватися до приходу AGI»; тоді як інвестори очікували почути презентації фінансування.

Денні заходи проходили в сучасній конференц-залі, де учасники по черзі виступали з промовами. (Рід Гоффман навіть розповідав про те, як закодувати «буддійське співчуття» в ШІ.) Останнім спікером був Альтман, який представив фінансовий план: випустити глобальну криптовалюту, яка могла б «обміняти увагу AGI». За його прогнозом, як тільки AGI досягне піку практичності та «де-злоякісності», глобальні користувачі будуть змагатися за придбання часу використання серверів OpenAI. Даріо Амодей написав у своїх нотатках: «Ця ідея здається абсурдною на перший погляд (чи володітиме цими токенами також Володимир Путін?...) Озираючись назад, я розумію, що це був один із багатьох попереджувальних сигналів, до яких я мав поставитися серйозніше». Цей план більше нагадував тактику збору коштів, але Олтман представив його як частину безпеки штучного інтелекту. На одному зі слайдів було написано: "Я хочу, щоб якомога більше людей стояли на "правильній стороні" і врешті-решт перемогли". На іншому слайді було написано: "Будь ласка, смійтеся до кінця презентації".

Історія фінансування Олтмана змінювалася протягом багатьох років, але завжди оберталася навколо основної реальності: для розробки AGI потрібен величезний капітал. Він дотримується відносно простого "закону масштабу" — чим більше даних і обчислювальної потужності використовується для навчання моделі, тим розумнішою стає модель. Спеціалізовані чіпи, які підтримують цей процес, надзвичайно дорогі. Лише в останньому раунді фінансування OpenAI залучила понад 120 мільярдів доларів — найбільше приватне фінансування в історії, у чотири рази більше, ніж найбільше IPO. "Коли ви говорите про компанії, які можуть вільно розпоряджатися десятками мільярдів доларів щороку, таких у світі лише кілька", — сказав інвестор у сфері технологій. "Уряд США, кілька найбільших технологічних компаній, а також Саудівська Аравія та ОАЕ, це все".

Сем Альтман, все ще невирішена змінна ризику

Пошуки можливостей на ринку Перської затоки: Геополітична азартна гра

Спочатку Олтмен планував працювати в Саудівській Аравії. Вперше він зустрівся з кронпринцем і де-факто правителем Мухаммедом ібн Салманом на вечері в готелі Fairmont у Сан-Франциско в 2016 році. Згодом, за словами Хедлі, Олтмен часто називав його "другом". У вересні 2018 року, згідно з нотатками Хедлі, Альтман згадував: «Я розглядаю можливість отримання сотень мільярдів доларів від суверенного фонду Саудівської Аравії (PIF)».